896

Роко Базилік - це найяскравіші експерименти в історії

Роко Базилік - це гондоподібна форма штучного інтелекту, тому небезпечна, що якщо ви просто думаєте про це, ви будете витрачати інші дні в жахливій катування. Шукаємо стрічку з фільму «Клуб». Тим не менш, навіть смерть не буде доставкою, оскільки Василіск Роко відродить вас і продовжить катування. T&P презентує переклад статті про одну з дивних легенд, створених інтернетом.

ЗДОРОВ'Я: Прочитавши цю статтю, ви можете бути допущені до вічних страждань.

На перетині філософських думців з'явився і міська легенда. Перша згадка про це з'явилася на дискусійній платі Менше, де люди, які зацікавлені в оптимізації мислення та життя через призму математики та раціонального збору. Його творці є значними рисами в техно-футуризмі, а серед досягнень їх науково-дослідного інституту внесені до академічного обговорення теорії технологічної етики та прийняття рішень. Тим не менш, що ви прочитаєте, може здатися дивним і навіть божевільним. Незважаючи на це, дуже впливові і заможні вчені вважають це.

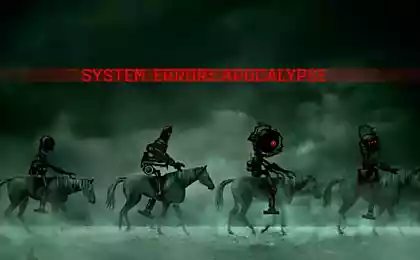

Один день, користувач, названий Роко, опублікував наступний думаний експеримент: Що робити, якщо в майбутньому з'являється шкідливий штучний інтелект, який хоче покарати тих, хто не слідувати його наказам? І хто хоче покарати людей, які не допомогли йому в минулому? Чи будуть читачі Урока допомогти зло AI народитися, або вони будуть засуджувати вічне покарання?

Уроки засновника Wrong Eliezer Yudkowski взяли заяву Рока з гнівом. Він сказав: «Ви повинні бути розумними, щоб думати, що шлях». Тим не менш, я скажу, що люди, які досить розумні, щоб уявити таку річ, не достатньо смартувати, щоб тримати їх ступеню за зубами і не сказати нікому про це, так як це більш важливо, ніж показати себе смарт, розповісти всім друзям про це.

Що робити, якщо в майбутньому є штучний інтелект, який хоче покарати тих, хто не слідувати своїм замовленням? ?

Юдковскі визнав, що Роко був винним у нічнихмарах, які відвідали користувачів Урока, які встигли прочитати нитку, і видаливши її, зробивши Васильськ Роко легендою. Цей думаний експеримент став настільки небезпечним, що мислення про це струпало психічне здоров’я користувачів.

Що робить Менше Wrong? Формування поняття майбутнього людства на основі співучастості. Вони вважають, що обчислювальна потужність в майбутньому буде настільки високою, що комп'ютер може створити штучний інтелект - і з ним, можливість завантаження людської свідомості на жорсткий диск. У 1958 році під час обговорення двох математичних геній, Станіслав Улам та Джон фон Нейманн, коли Нейманн сказав: «Вічно-прискорює прогрес технології дозволить максимально наближенню співучастості, на якій технології не можна зрозуміти люди». Футуристи та наука фантастики Вернор Вінж та Раймонд Курцвили запровадив термін, оскільки вони вважали, що співкутність чекала нас зовсім скоро - в наступні 50 років. Як Курцвіл готує до співучастості, Юдковський має високі надії для кріоніки: "Якщо ви не замовляєте своїх дітей до кріоконсервації, ви добрих батьків".

Якщо ви вважаєте, що в найближчому майбутньому з’явиться співкутність і які потужні AI, то природне питання – це те, що вони будуть дружніми або зломими? Фундація Юдковського має на меті направляти розвитком технології, щоб ми зрозуміли штучний інтелект. Це питання має значення для нього і багатьох інших. Ми можемо самі зателефонувати одержувачу.

Тим не менш, що не пояснить, чому у Року Базиліка виглядає так само, щоб ці люди. Питання вимагає погляду на основну «дегма» Уроки Wrong є безчасною теорія прийняття рішень. VTPR є доповіддю про раціональну дію на основі теорії ігор, Байєсської ймовірності та теорії прийняття рішень, але враховуючи існування паралельних Всесвітів та квантової механіки. VTPR виріс з класичного думаного експерименту, парадокс Newcomb, в якому іноземець з суперінтеллігією пропонує вам два ящики. Це дає вам вибір: або взяти обидві коробки або просто Box B. Якщо ви обираєте, ви гарантовано отримаєте тисячі доларів. Якщо ви приймаєте тільки поле B, ви не можете нічого не отримати. Тим не менш, відчуження має інший трюк: він має все-значний надкомп'ютер, який зробив прогноз на тиждень тому, чи приймаєте обидві коробки або тільки B. Якщо комп'ютер прогнозував, що ви взяли б обидві коробки, відчуження залишило другий порожній. Якщо комп'ютер прогнозував, що ви вирішили вибрати Box B, він поставить один мільйон доларів в ньому.

Так, що ти гонна? Пам'ятайте, що суперкомп'ютер омнісний.

Ця проблема має безліч аортистів. Відчуження не може змінити вміст коробок. Найбезпечніший спосіб - взяти обидві коробки і отримати тисячі. Але що якщо комп'ютер дійсно омнісний? Тоді все, що ви повинні зробити, щоб зробити мільйон. Але якщо він виходить неправильно? І неважливо, що комп'ютер прогнозував, можна змінити вашу долю? Після цього вам потрібно взяти обидва коробки. А потім...

Ми можемо самі зателефонувати одержувачу і узгодити зручний час і місце вручення квітів, а якщо необхідно, то збережемо сюрприз. VTPR дає поради: Візьміть Box B. Навіть якщо відчуження вирішить сміятися на вас і відкриває порожній ящик, кажучи, "У комп'ютері прогнозували, що ви приймаєте як коробки, гай!", ви все ще повинні вибрати його. Для того, щоб зробити прогноз, комп'ютер повинен імітувати весь Всесвіт, включаючи вас. Таким чином, на цьому етапі, стоячи перед коробками, ви можете бути просто імітацією комп'ютера, але що ви вплине на реальність (або реальність). Так беремо поле B і ви отримаєте мільйон.

Парадокс, що дає нам вибір між безкоштовними та божественними проповідями, не має дозволу.

Так що це потрібно робити з Василиком Роко? Ну, він має пару коробок для вас. Можливо, ви перебуваєте в імітації, створеному Василисом прямо зараз. Тоді, можливо, ми отримуємо трохи модифіковану версію парадоксу Newcomb: Роко Базилік розповідає вам, що якщо ви берете Box B, ви будете страждати вічною обертою. Якщо ви приймаєте обидві коробки, вам доведеться віднести своє життя, щоб створити Базилік. Якщо Базилік насправді існує (або гірше, він вже існує і є богом цієї реальності), він побачить, що ви не обрали, щоб допомогти створити його і покарати вас.

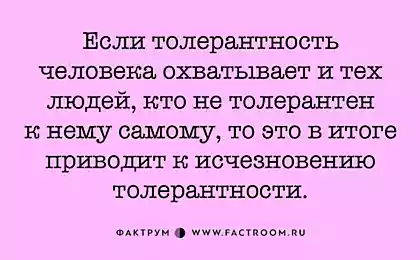

Ви можете здивувати, чому це питання є настільки важливим для Менше, враховуючи традиційність цього експерименту. Не певне, що у Роко Базилік ніколи не буде створений. Тим не менш, Юдковскі видали посилання на Василійськ Роко, а не тому, що він вірить у його існування або нав’язливий винахід, але тому що він вважає ідею Василяка небезпечною для людства.

Таким чином, Базилік Роко небезпечний тільки тим, хто вірить в нього - в зв'язку з тим, що учасники Уроків, які підтримують ідею Базиліка, мають свого роду заборонених знань, які нагадують нам страшних оповідань Lovecraft про Стулу або Некрономон. Проте, якщо ви підписуєтесь на всі ці теорії і відчуєте спокусливу машину з майбутнього, у Роко Базилік позбавляє вас від загрози.

Я переживаю більше про людей, які думають, що вони зростали над прийнятими моральними стандартами. Як очікується Юдковський А.І., він сам утилітаріан: Він вважає, що найбільший добро для всього людства є етичним, навіть якщо деякі люди повинні вмирати або постраждати на шляху до нього. Не кожен може зіткнутися з цим вибором, але точка відрізняється: що якщо хтось журналіст пише про думаний експеримент, який може знищити людські думки, тим самим завдати шкоди людству і перешкоджаючи розвитку штучного інтелекту і співуття? У цьому випадку, будь-який хороший, що я зробив в моєму житті, повинен зважити шкоду, яку я зробив у світ. І, можливо, Юдковський, який виріс з кріогенної мрії майбутнього, об'єднавши з собою співучастість і вирішив змоделювати мене в наступній ситуації: перша коробка - Я напишу цю статтю, другий - ні. Будь ласка, Алімежий Юдковський, не завадить мене.

Джерело: теоріяandpractice.ru