891

0.3

2016-09-21

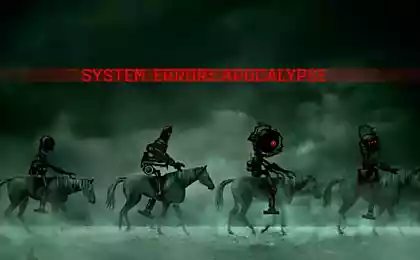

Василиск Роко — самый пугающий мысленный эксперимент в истории

Василиск Роко — это богоподобная форма искусственного интеллекта, опасная настолько, что если вы просто о ней подумаете, то проведете остаток дней в ужасающих пытках. Похоже на кассету из фильма «Звонок». Однако даже смерть не станет избавлением, ведь Василиск Роко воскресит вас и продолжит свои пытки. T&P представляют перевод статьи об одной из самых странных легенд, порожденных интернетом.

ПРЕДУПРЕЖДЕНИЕ: прочитав эту статью, вы можете обречь себя на вечные страдания и мучения.

Василиск Роко появился на стыке философского мысленного эксперимента и городской легенды. Первое упоминание о нем появилось на дискуссионном борде Less Wrong, где собираются люди, заинтересованные в оптимизации мышления и жизни через призму математики и рациональности. Его создатели являются значимыми фигурами в техно-футуризме, и среди достижений их исследовательского института — вклад в академическую дискуссию о технологической этике и теории принятия решений. Однако то, что вы собираетесь сейчас прочитать, может показаться странным и даже безумным. Несмотря на это, весьма влиятельные и состоятельные ученые верят в это.

Однажды пользователь с именем Roko выложил следующий мысленный эксперимент: что если в будущем возникнет злонамеренный искусственный интеллект, который захочет наказать тех, кто не выполняет его приказы? И что если он захочет наказать тех людей, которые в прошлом не способствовали его созданию? Стали бы в таком случае читатели Less Wrong помогать злому ИИ появиться на свет или были бы обречены им на вечные мучения?

Основатель Less Wrong Елиезер Юдковски с гневом воспринял высказывание Roko. Вот что он ответил ему: «Вы, должно быть, умны, раз пришли к такой мысли. Однако меня печалит, что люди, которые достаточно умны, чтобы представить себе такое, недостаточно сообразительны, чтобы ДЕРЖАТЬ СВОЙ ДУРАЦКИЙ ЯЗЫК ЗА ЗУБАМИ и никому не говорить об этом, так как это важнее, чем показать себя умным, рассказывая об этом всем своим друзьям».

«Что если в будущем возникнет искусственный интеллект, который захочет наказать тех, кто не выполняет его приказы?»

Юдковски признал, что Роко повинен в кошмарах, посещающих пользователей Less Wrong, успевших прочесть тред, и удалил его, благодаря чему Василиск Роко стал легендой. Этот мысленный эксперимент стал настолько опасным, что размышления о нем ставили под угрозу душевное здоровье пользователей.

Чем же занимается Less Wrong? Формированием концепции будущего человечества на основе сингулярности. Они верят, что вычислительная мощность в будущем станет настолько высокой, что с помощью компьютера можно будет создать искусственный интеллект — а вместе с ним и возможность загружать человеческое сознание на жесткий диск. Термин «сингулярность» возник в 1958 году в ходе дискуссии двух гениев математики — Станислава Улама и Джона фон Неймана, когда Нейман сказал: «Постоянно ускоряющийся прогресс технологий сделает возможным приближение сингулярности, при которой технологии не смогут быть поняты людьми». Футуристы и писатели-фантастывроде Вернора Винджа и Рэймонда Курцвейла популяризировали термин, так как считали, что сингулярность ждет нас всех уже очень скоро — в ближайшие 50 лет. Пока Курцвейл готовится к сингулярности, Юдковски возлагает большие надежды на крионику: «Если вы заранее не записали своих детей на криоконсервацию, вы — паршивые родители».

Если вы верите, что грядет сингулярность и что мощные ИИ появятся уже в ближайшем будущем, возникает закономерный вопрос: будут ли они дружелюбными или злыми? Фонд Юдковски ставит своей целью так направить развитие технологий, чтобы у нас появился именно дружественный искусственный интеллект. Этот вопрос для него и многих других людей имеет первостепенное значение. Сингулярность приведет нас к машине, эквивалентной богу.

Тем не менее это не объясняет, почему Василиск Роко выглядит таким ужасным в глазах этих людей. Вопрос требует взгляда на главную «догму» Less Wrong — «вневременную теорию принятия решений» (ВТПР). ВТПР — это руководство к рациональным действиям, основанное на теории игр, байесовской вероятности и теории принятия решений, но с учетом существования параллельных вселенных и квантовой механики. ВТПР выросла из классического мысленного эксперимента — парадокса Ньюкома, в котором пришелец, обладающий сверхразумом, предлагает вам две коробки. Он дает вам выбор: либо взять обе коробки, либо только коробку Б. Если выбрать обе, то вы гарантированно получите тысячу долларов. Если взять только коробку Б, вы можете не получить ничего. Однако у пришельца припасен еще один трюк: у него есть всезнающий суперкомпьютер, который сделал неделю назад прогноз, возьмете ли вы обе коробки или только Б. Если бы компьютер предсказал, что вы возьмете обе коробки, пришелец оставил бы вторую пустой. Если бы компьютер предсказал, что вы выберете коробку Б, он бы положил туда один миллион долларов.

Итак, что собираетесь делать? Помните, что суперкомпьютер всеведущ.

Эта проблема сбила с толку множество теоретиков. Пришелец уже не может изменить содержимое коробок. Надежнее всего взять обе коробки и получить свою тысячу. Но вдруг компьютер и правда всеведущ? Тогда вам только и остается взять коробку Б, чтобы получить миллион. Но если он окажется неправ? И независимо от того, что предсказал компьютер, — неужели никак нельзя изменить свою судьбу? Тогда, черт побери, нужно брать обе коробки. Но в таком случае…

Сводящий с ума парадокс, заставляющий нас выбирать между свободой воли и божественным предсказанием, не имеет разрешения, и люди могут только пожимать плечами и выбирать наиболее комфортный для них вариант. ВТПР дает совет: берите коробку Б. Даже если инопланетянин решил посмеяться над вами и откроет пустую коробку со словами: «Компьютер предсказал, что ты возьмешь обе коробки, ха-ха!» — вы все равно должны ее выбрать. Обоснование этому следующее: для того, чтобы сделать прогноз, компьютер должен был симулировать всю Вселенную, включая и вас. Таким образом, в этот момент, стоя перед коробками, вы можете являться всего лишь симуляцией компьютера, но то, что вы сделаете, будет влиять на реальность (или реальности). Так что берите коробку Б и получите миллион.

«Сводящий с ума парадокс, заставляющий нас выбирать между свободой воли и божественным предсказанием, не имеет разрешения»

Какое же отношение это имеет к Василиску Роко? Ну, у него тоже есть пара коробочек для вас. Может быть, вы прямо сейчас находитесь в симуляции, созданной Василиском. Тогда, возможно, мы получаем несколько модифицированную версию парадокса Ньюкома: Василиск Роко говорит вам, что если вы возьмете коробку Б, то подвергнетесь вечным мучениям. Если же вы возьмете обе коробки, то вынуждены будете посвятить свою жизнь созданию Василиска. Если Василиск на самом деле будет существовать (или, хуже того, он уже существует и является богом этой реальности), он увидит, что вы не выбрали вариант помощи в его создании и покарает вас.

Может быть, вы удивлены, почему этот вопрос так важен для Less Wrong, учитывая условность этого мыслительного эксперимента. Не факт, что Василиск Роко когда-нибудь будет создан. Однако Юдковски удалил упоминания о Василиске Роко не потому, что верит в его существование или скорое изобретение, а потому, что считает идею Василиска опасной для человечества.

Таким образом, Василиск Роко опасен только для тех, кто в него верит — в связи с этим участники Less Wrong, поддерживающие идею Василиска, обладают своего рода запретным знанием, что напоминает нам страшные истории Лавкрафта о Ктулху или Некрономиконе. Однако, если вы не подписываетесь под всеми этими теориями и не чувствуете искушения повиноваться коварной машине из будущего, Василиск Роко не представляет для вас никакой угрозы.

Я больше беспокоюсь о людях, которые считают, что поднялись выше общепринятых моральных норм. Подобно ожидаемому Юдковски дружественному ИИ, он и сам является утилитаристом: он считает, что величайшее благо для всего человечества этически оправданно, даже если несколько человек должны умереть или мучиться на пути к нему. Не каждый может столкнуться с подобным выбором, но дело в другом: что если какой-нибудь журналист напишет о мысленном эксперименте, который может разрушить сознание людей, нанеся, таким образом, человечеству вред и помешав прогрессу в области разработки искусственного интеллекта и сингулярности? В этом случае любое добро, что я сделал за свою жизнь, должно перевесить вред, что я принес миру. А, возможно, восставший из криогенного сна Юдковски будущего слился с сингулярностью и решил симулировать меня в следующей ситуации: первая коробка — я напишу эту статью, вторая — нет. Пожалуйста, всемогущий Юдковски, не делай мне больно.

Источник: theoryandpractice.ru

Портал БАШНЯ. Копирование, Перепечатка возможна при указании активной ссылки на данную страницу.