605

Чи потрібні роботи емпатії?

р.

р.Ми працюємо над революцією робототехніки та науковцями та інженерами. Помилки діляться на два табори: майбутні обіцянки нас робототехнікою, апокаліпсом, або роботодавцем візьмуть місце собак у ролі кращих друзів людини. І з точки зору деяких сучасних мислителів і візій, другий сценарій можливо тільки якщо є емпатією в роботі. Детальніше спеціально, штучний інтелект.

Наслідки виклику AI нещодавно повністю відчували Microsoft, перенесли дроблення фіаско з його відомим чат-ботом ім. Тая. Він запрошував вчитися на основі взаємодії з користувачами Twitter. В результаті прогулянки миттєво перетворили 19-річну дівчину, відіграну ботом, в сексуально попереджену нацизму. Після запуску розробники мали відключити бота. Цей випадок так чітко продемонстрував важливість проблеми перейде в дисперсний AI, який один з розділів Google — DeepMind — разом з експертами з Оксфорда, що займається розробкою технології «енергетичний перемикач» для AI, доки вони стали реальною загрозою.

У нижньому рядку є те, що AI не поступається інтелекту людиною, і спирається тільки на самостійний розвиток і оптимізацію, може прийти до висновку, що люди хочуть відключити її або запобігти його від отримання ресурсів, які вони хочуть. І відповідно до цього висновку, штучний інтелект вирішить діяти проти людей, незалежно від того, наскільки виправдані її підозри. Ільєзер Юдковскі сказав, що «Я не любить тебе, ні тебе не завадить». Але ви робите з атомів, які він може використовувати для свого використання. й

І якщо загроза від AI, що живе в хмарі суперкомп'ютер, здається ефемерним для вас прямо зараз, що ви скажете про повноцінний робот, електронні мізки яких дають піднятися на ідею, що ви перешкоджаєте його від життя?

Один із способів, щоб переконатися, що робота, і AI в цілому, залишаються на боці доброго, щоб перенести їх емпатією. Це не достатньо, але є необхідною умовою за багатьма експертами. Ми просто збираємось будувати роботи, які можуть гасити.

Нещодавно Елон Муск і Стівен Гокінн написав відкритий лист до Центру дослідження перспективного ризику (CSER) для більш детального дослідження «потенційні підводні камені» в AI. За словами авторів листа, штучний інтелект може стати більш небезпечним, ніж ядерна зброя, і Божінг, як правило, вважає, що ця технологія буде кінець людства. Для захисту від апкаліптичного сценарію запропоновано створити сильну AI (AGI, штучний загальний інтелект) з вбудованою психологічною системою, як людиною, або повністю імітувати нейронні реакції людини в AI.

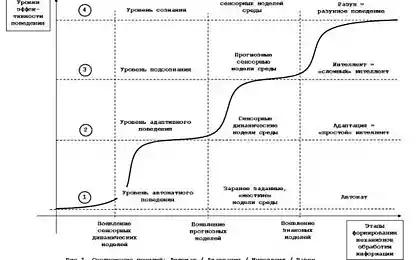

На щастя, час не втрачається і ми можемо вирішити, в якому напрямку ми повинні йти. За словами експертної спільноти, поява сильних AI, не поступається людині, можливе в діапазоні від 15 до 100 років. При цьому ліміти діапазону відображають екстремальні ступені оптимізму та песимізму, більш реалістичні умови - 30-50 років. За межами ризику небезпечного AI без моральних принципів, багато страхів, що поточна економічна, соціальна та політична турмойл може призвести до творців сильних AI, щоб спочатку прагнути перетворити їх на нову зброю, тиск або конкуренцію. І не остання роль тут будуть відіграні незламні капіталізми у вигляді корпорацій. Великий бізнес завжди невдовзі в оптимізації і максимізації процесів, і завжди буде спокусою плавати за буйами, щоб отримати конкурентну перевагу. Деякі уряди та корпорації, ймовірно, намагаються зробити сильний AI в управління ринками та виборами, а також розвиток нової зброї, а також інших країн, доведеться адекватно реагувати на ці кроки, пов'язані з перегонами зброї AI.

Не можна сперечатися, що AI обов'язково стане загрозою для людства. Тому не потрібно намагатися заборонити розвиток в цій області, і це безперечно. Здається, що тільки закони робототехніки Асимов ми не можемо зробити, і це необхідно за замовчуванням для реалізації «емоційних» зловживань, які роблять роботи мирними і дружніми. Так вони можуть створити свого роду дружби, вони можуть розпізнати і зрозуміти емоції людей, можливо, навіть суперечать. Це може бути досягнуто, наприклад, шляхом копіювання нейронної структури мозку людини. Деякі експерти вважають, що це теоретично можливе створення алгоритмів та обчислювальних структур, здатних діяти як мозок. Але оскільки ми ще не знаємо, як це працює, це довгострокове завдання.

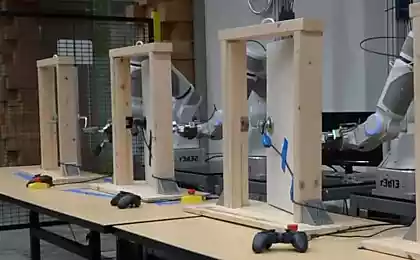

На ринку вже працюють роботи, які можуть технічно розпізнати певні людські емоції. Наприклад, Nao є тільки 58 см, висока і зважує 4,3 кг, робот оснащений програмним забезпеченням для розпізнавання обличчя. Він здатний зробити контакт очей і реагувати при розмові. Цей робот був використаний для дослідницьких цілей, щоб допомогти аутистичному дітям. Ще одна модель від того ж виробника – Перець – здатний розпізнати слова, вирази обличчя та мову тіла, що діє відповідно до отриманої інформації.

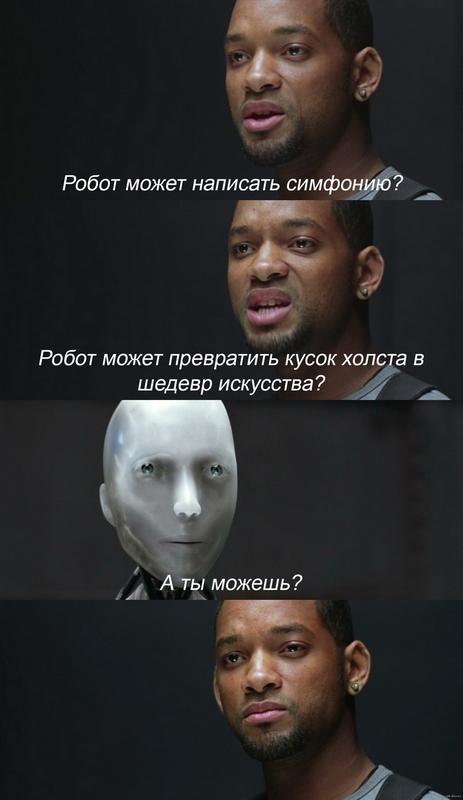

Але жоден з наших роботів не здатний відчувати себе. Щоб зробити це, вони потребують самодосвідомості, тільки тоді будуть роботи здатні відчувати себе так само, як і людина, зможе подумати про почуття.

Ми отримуємо краще при наслідуванні людських появ в роботі, але з внутрішнім світом, набагато складніше.

З емпатією можна зрозуміти в інших тих же почуттях, які ви колись відчували. І для цього роботи повинні пройти через власний період дозрівання, з його успіхами і невдачами. Вони повинні мати досвід вкладення, бажання, успіх, любов, небезпека, страх, можливо ревнощі. Так що робота, мислення про когось, думає про почуття людини.

Як працює робота? Гарне питання. Ви можете створювати віртуальні емулятори/симулятори, в яких AI отримає емоційний досвід, а потім завантажуються в фізичні органи. Або формувати штучні візерунки / комедії та штампувальні роботи з стандартним набором морально-етичних цінностей. Художня література Філіпа К. Дік, у своїх романах роботи часто працюють зі штучними спогадами. Але є ще одна сторона до емоційності роботів: нещодавній фільм Ex Machina описує ситуацію, де робот, керований сильним AI, так надійно відображає емоції, які він вводить людей на наступний план. Питання полягає в тому, як ви розповідаєте, коли робот – це просто відмова від ситуації, або коли він насправді відчуває однакові емоції, як ви? Зроби його голографічний гало, колір і візерунок якого підтверджують щирість емоцій, виражених роботом, як в аніме ЕВ немає Якана?

Але скажемо, що нам вдалося вирішити всі вищевказані проблеми і знайти відповіді на питання, що виникли. Чи буде нам працювати роботи, або будуть вони поступаються нам на соціальні сходи? Чи повинні люди контролювати свої емоції? Чи буде це свого роду хай-тек рабство, за яким роботи з сильним AI повинні мати можливість думати і відчувати спосіб, який ми хочемо?

У нас є багато складних питань, які ще не відповіли. На даний момент наші соціальні, економічні та політичні структури не готові до таких радикальних змін. Але все ж, рано чи пізно нам доведеться знайти прийнятні рішення, адже ніхто не може зупинити розвиток робототехніки, а деякі з них сильні AI здатні функціонувати в антропоморфному організмі. Для цього необхідно заздалегідь підготуватися.

Джерело: geektimes.ru/company/asus/blog/279914/