209

2016-09-20

Беспилотный самолет или когда мы собираемся дать роботам мораль?

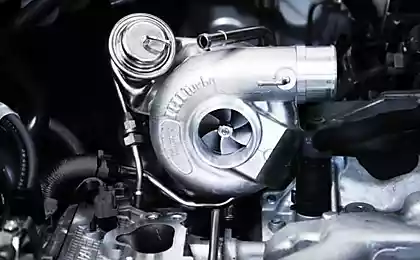

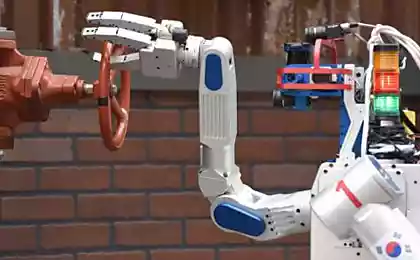

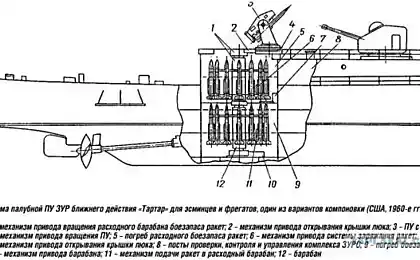

2015 год можно считать годом X-47B. Новый беспилотный самолет, разработанный компанией Northrop Grumman, подвергнут испытанию на американском военном корабле. Необходимо проверить, сможет ли он делать все, что могут делать существующие самолеты: безопасно взлетать и приземляться, поддерживать режим ожидания, и всего за 90 секунд «очищать палубу» для следующего самолета. Не удивительно, что к разработке военного дрона приковано столько внимания, ведь боевая авиация мира активно развивается в последнее время.

Среди существующих сейчас автономных аппаратов этот супер-дрон является, наверное, наиболее передовой машиной, омрачая, возможно, самоуправляемый автомобиль от Google. Оба примера искусственного интеллекта стали стимулом к подписанию коллективом влиятельных ученых открытого письма об искусственном интеллекте (ИИ).

Подписанный учеными — такими как профессор Стивен Хокинг, а также такими предпринимателями как Элон Маск, он предостерегает, что ИИ так быстро шагает к человекоподобному интеллекту, что мы не успеваем полностью осознать и понять его потенциал. Системы ИИ должны делать то, что мы хотим, чтобы они делали. Но, как могут процветать люди, когда много рабочих мест будет автоматизировано, в том числе в банковской и финансовой сфере. Будущее обещает беспрерывный отдых — или просто безработицу?

Возникает также множество вопросов, на которые нужно дать ответы уже сегодня. Например, кто должен нести ответственность, если самоуправляемый автомобиль станет причиной аварии? Ясность в правовом поле необходима для доверия потребителей, от которого зависит будущее этой индустрии.

Если мы собираемся дать роботам мораль, то какая мораль должна быть заложена? А как относительно саботажа? Идея моральной машины зачаровывает, так как в эпоху, когда машины уже делают многое из того, что могут делать люди — вести автомобиль, руководить самолетом, бегать, узнавать изображение, говорить и даже переводить — все еще существуют компетенции, такие как моральные соображения, которые обходят их.

Действительно, с ростом уровня автоматизации, это упущение может стать само по себе аморальным. Например, если дроны станут нашими эмиссарами на поле боя, им, возможно, придется принимать решения, которые люди не смогут предусмотреть или закодировать в программе. И эти решения, могут быть «моральными» решениями — какую, например, с двух жизней сохранить.

P.S. И помните, всего лишь изменяя свое сознание — мы вместе изменяем мир! ©

Источник: mirnt.ru/aviation/bespilotnyy-samolet

Портал БАШНЯ. Копирование, Перепечатка возможна при указании активной ссылки на данную страницу.