3037

Логіка мислення. Зареєструватися 3. Перцептрон, забруднювальні мережі

У першій частині описано властивості нейронів. У другому вони говорили про основні властивості, пов'язані з їх навчанням. У наступній частині ми підемо описати, як працює реальний мозок. Але перед тим, що ми повинні зробити одну останню силу і охопити трохи більше теорії. Тепер, ймовірно, не буде виглядати дуже цікаво. Помилки Я б пропустив таку навчальну посаду. Але все це «азбукка» допоможе нам зрозуміти в майбутньому.

перцептрон

У машинному навчанні є два основні підходи: навчання з викладачем та навчанням без вчителя. Охарактеризовано методи висвітлення основних компонентів без вчителя. Нейромережа отримує пояснення того, що вона подається до неї. Просто висвітлює статистичні візерунки, присутні в потоці даних введення. На відміну від того, що навчання вчителя припускає, що для порції вхідних зображень, що називається зразкам навчання, ми знаємо, що вихід ми хочемо отримати. Відповідно, завдання полягає в налаштуванні нейромережі для захоплення шаблонів, які посилають вхідні та вихідні дані.

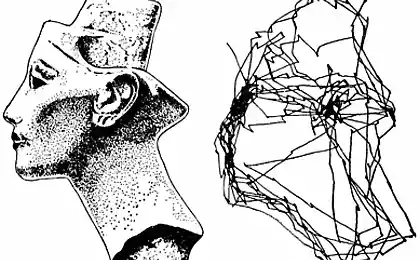

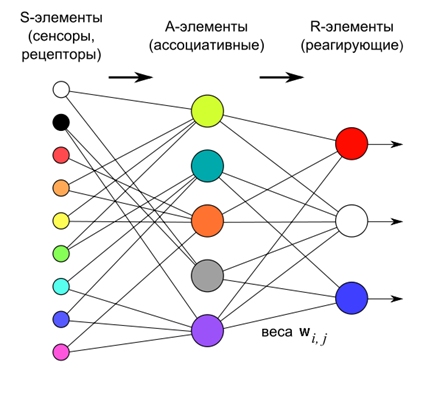

У 1958 році Франк Розенblatt описав дизайн, який назвав перцептрон (Росенблатт, 1958), який здатний навчатися з викладачем (див. КDPV).

За даними Розенблата, перцептрон складається з трьох шарів нейронів. Першим шаром є сенсорні елементи, які визначають, що у нас є вхід. Другий шар - асоціативні елементи. Їх з'єднання з сенсорним шаром жорстко визначені і визначають перехід на більш загальний асоціативний малюнок опису, ніж на сенсорному шарі.

Перцептронне навчання здійснюється шляхом зміни маси нейронів третього шару реагації. Мета тренінгу полягає в тому, щоб отримати перцепрон, щоб правильно класифікувати подані зображення.

Нейрони третього шару працюють як порігові добавки. Відповідно, вага кожного з них визначають параметри певного гіперплану. Якщо є лінійно відокремлені вхідні сигнали, виводні нейрони можуть діяти як їх класифікатори.

Якщо це реальний вихідний вектор перцептрона, вектор, який ми очікуємо отримання, то вектор помилки говорить про якість нейромережі:

Якщо ви встановите мету, щоб мінімізувати середню квадратну похибку, ви можете занурити так званий правило дельти модифікації ваги:

У цьому випадку початкова апроксимація може бути нульовою вагою.

Це правило не є іншим, ніж правило Hebb застосовується до справи перцептону.

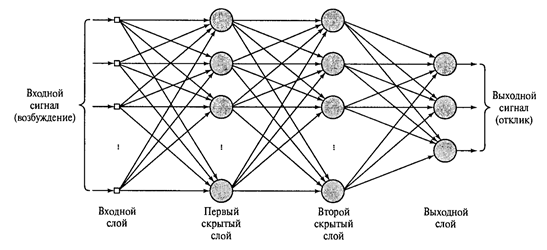

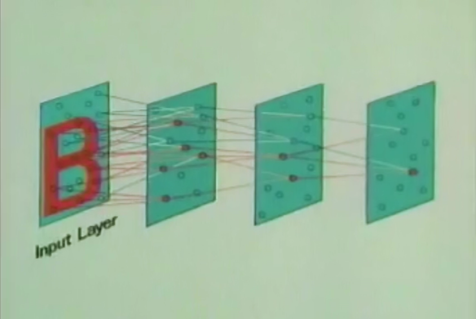

Якщо ми розміщуємо один або більше реагуючих шарів за вихідним шаром і відкидаємо асоціативний шар, який був представлений Rosenblatt більш біологічною певненістю, ніж для обчислювальної потреби, ми отримуємо багатошаровий перцептрон, як показано на малюнку нижче.

р.

р.Багатошаровий перцептрон з двома прихованими шарами (Хайкін, 2006)

Якщо нейронси реагуючих шарів були простими лінійними добавками, в такому ускладненнях буде мало сенсу. Вихід, незалежно від кількості прихованих шарів, все одно буде лінійним поєднанням вхідних сигналів. Але так як приховані шари використовують порігові добавки, кожен новий шар розбиває лінійність ланцюга і може носити свій цікавий опис.

Довгий час було незрозуміло, як навчати багатошаровий перцептрон. У 1974 р. описано базовий метод запорагації. А.І. Галушкін і самостійно і одночасно Павло J. Verbos. У 1986 році був відомий у 1986 році (Дав Є. Румельхарта, Геофрей Е. Хінтон, Рональд Дж. Вільямс, 1986).

Метод складається з двох проходів: прямі і зворотні. У безпосередній проходженні передбачений навчальний сигнал та діяльність всіх вузлів мережі, в тому числі активність вихідного шару. Відстеження отриманої активності від того, що було потрібно для отримання, визначається сигнал помилки. При зворотному проході сигнал про помилку в зворотному напрямку, від виходу до входу. Синоптичні ваги регулюються для мінімізації цієї помилки. Детальний опис методу можна знайти в багатьох джерелах (наприклад, Haikin, 2006).

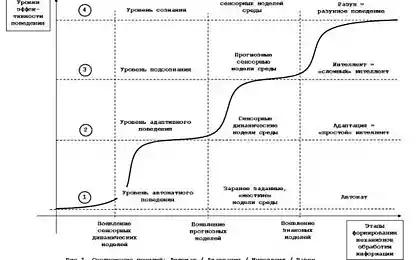

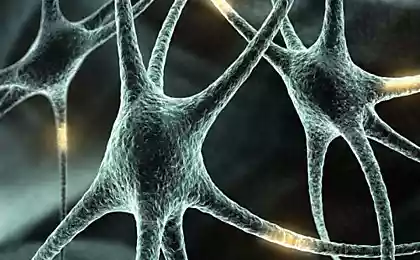

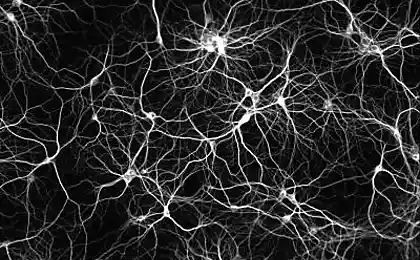

Важливо звернути увагу на те, що в багатошаровому перцептоні інформація обробляється від рівня до рівня. У той же час кожен шар виділяє власний набір характеристик, характерних для вхідних сигналів. Це створює певні аналогії з тим, як інформація трансформується між ділянками кори головного мозку.

Супутні мережі. неоконтейнер

Порівняння багатошарового перцептону і реального мозку є дуже довільним. Що спільного є те, що як ми піднімаємось з зони до зони в корі, або від шару до шару в перцепроні, інформація стає більш узагальненою. Однак структура кори набагато складніше, ніж організація шару нейронів в перцептроні. Дослідження візуальної системи Д. Губеля та Т. Зроблено можливість краще зрозуміти структуру візуальної кори і підштовхуватися до використання цих знань в нейромережах. Основними ідеями, які були використані, є місцевість зон сприйняття і поділ нейронів за допомогою функції в межах одного шару.

Ми можемо самі зателефонувати одержувачу і узгодити зручний час і місце вручення повідомлень. Раніше ми сказали, що ця область відстеження називається рецептивним полем нейрона.

Концепція рецептивного поля вимагає окремої чіткості. Традиційно рецептивне поле нейрона називається рецепторним простором, що впливає на роботу нейрона. Рецептори – нейрони, які безпосередньо сприймають зовнішні сигнали. Уявіть нейронну мережу, що складається з двох шарів, де перший шар - шар рецепторів, а другий шар - нейрони, підключені до рецепторів. Для кожного нейрона другого шару рецептори, які контактують з ним, є його рецептивним полем.

Тепер візьміть складну багатошарову мережу. Далі ми йдемо з входу, більш складний буде уточнювати, які рецептори і як вони впливають на активність глибоких нейронів. У певній точці, можливо, для будь-якого нейрона, всі існуючі рецептори можна назвати його рецептурним полем. У такій ситуації рецептивне поле нейрона – це тільки ті нейрони, з якими має прямий синоптичний контакт. Для того, щоб викликати ці поняття, ми будемо називати простір вхідних рецепторів – оригінальне поле рецептів. І простір нейронів, що взаємодіє з нейронами безпосередньо - локальним рецептурним полем або просто рецептивним полем, без подальшої чіткості.

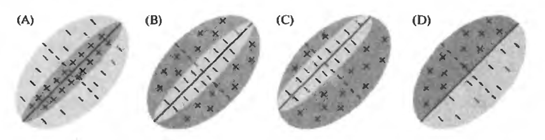

Розподіл нейронів в функції асоціюється з виявленням двох основних типів нейронів в первинній візуальній кори. Прості нейрони відповідають стимулу, розташованому на певному місці в оригінальному рецептивному полі. Комплексні нейрони діють на стимул, незалежно від його положення.

Наприклад, на малюнку нижче показано параметри для яких моделей чутливості оригінальних рецептів простих клітинок. Позитивні області активізують такі нейрони, негативні пригнічення. Для кожного простого нейрона існує стимул, який найбільш підходить для нього і, відповідно, викликає максимальну активність. Але головне, що цей стимул щільно прив'язується до положення на оригінальному рецептивному полі. Те ж подразники, але зміщені в сторону, не спричиняють простого нейрона для реагації.

Оригінальні рецептивні поля простої клітинки (Nichols J., Martin R., Wallas B., Fuchs P.)

Комплексні нейрони також мають свій кращий стимул, але здатні розпізнати цей стимул незалежно від його положення на оригінальному рецептивному полі.

З цих двох ідей народжуються відповідні моделі нейромереж. Перша така мережа була створена Kunihika Fukushima. Він називається конітроном. Пізніше розвинена більш розвинена мережа, неопізнатрон (Fukushima, 1980). Neocognitron - будівництво декількох шарів. Кожен шар складається з простих (s) і складних (c) нейронів.

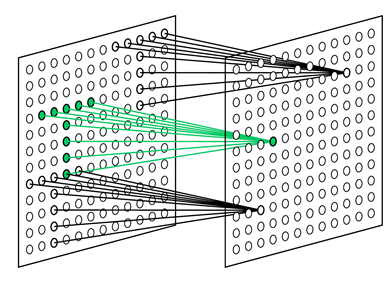

Завдання простого нейрона полягає в тому, щоб контролювати її сприйняття поля і розпізнати зображення, для якого він навчається. Прості нейрони зібрані в групах (плани). У тій же групі прості нейрони налаштовують до того ж подразника, але кожен нейрон дивиться на її фрагмент рецептивного поля. Разом вони проходять всі можливі позиції цього образу (фото нижче). Всі прості нейрони на одній площині мають однакові ваги, але різні рецептивні поля. Ви можете уявити ситуацію по-різному, що це один нейрон, який може спробувати на своєму зображенні відразу на всі позиції оригінальної картини. Все це дозволяє розпізнати однаковий образ незалежно від його положення.

Прийняття полів простих клітин, спрямованих на пошук вибраного шаблону в різних положеннях (Fukushima K., 2013)

Кожен комплексний нейрон контролює свою площину простих нейронів і пожеж, якщо хоча б одна з простих нейронів у її площині активно (рис. нижче). Діяльність простого нейрона свідчить про те, що вона визнала характерний подразник в тому чи іншому місці, який є його рецептивним полем. Діяльність комплексної нейронної функції полягає в тому, що однаковий образ був знайдений на всіх шарах, що контролюється простими нейронами.

Neocognitron літаки

Кожен шар після введення має картину, утворену складними нейронами попереднього шару. З шару до шару, є збільшення узагальнення інформації, яка в результаті призводить до визнання конкретних зображень, незалежно від їх розташування на оригінальному малюнку і деяких перетвореннях.

При нанесенні на аналіз зображень, це означає, що перший рівень розпізнає лінії під певним кутом, що проходить через невеликі корекційні поля. Визначити всі можливі напрямки в будь-якій точці зображення. Наступний рівень виявляє можливі комбінації елементарних особливостей, що визначають більш складні форми. І так, поки ви можете визначити бажаний образ (фото нижче).

Процес розпізнавання в неоконтейтроні

При використанні для розпізнавання рукописного тексту цей дизайн стійкий до способу написання. Успіх визнання не впливає на рух на поверхню або обертання, ані деформації (зміцнення або стиснення).

Найяскравіша різниця між неоконтейтроном і повністю обмеженим багатошаровим перцептроном є значно меншою кількістю ваг, що використовуються для тієї ж кількості нейронів. Це пов’язано з «триком», що дозволяє неоконтейтрону визначати зображення незалежно від їх положення. площина простих клітин, по суті, один нейрон, вага якого визначають ядро конволюції. Цей сердечник наноситься на попередній шар, що виконується через нього в усіх можливих положеннях. Власне, нейрони кожної площини і встановлюють координати з'єднань цих позицій. Це призводить до того, що всі нейрони шару простих клітин контролюють, чи з'являється зображення, що відповідає нуклеї в їх рецептивному полі. Тобто, якщо таке зображення відбувається в будь-якому місці в вхідному сигналі для цього шару, буде виявлено принаймні один простий нейрон і викликати активність відповідного комплексу нейрон. Цей трюк дозволяє знайти характерний образ в будь-якому місці. Але ми повинні пам'ятати, що це трюк і він не особливо відповідає роботі реальної кори.

Неоконітронне навчання відбувається без вчителя. Відповідає раніше описану процедуру виділення повного набору факторів. Коли реальні зображення подаються в неоконтейтрон, нейрони не мають вибору, але виділити компоненти, властиві цим зображенням. Таким чином, якщо ви подаєте рукописні цифри до введення, невеликі рецептури полів простих нейронів першого шару побачать лінії, кути і з'єднання. Розмір зони змагань визначає, скільки різних чинників можна виділити в кожному просторовому районі. В першу чергу виділяються найбільш важливі компоненти. Для рукописних цифр, вони будуть лініями під різними кутами. Якщо залишаються вільні фактори, то можна виділити більш складні елементи.

Від шару до шару зберігається загальний принцип навчання - виділяються фактори, характерні для багатьох вхідних сигналів. Подаючи рукописні цифри до першого шару, на певному рівні ми отримуємо фактори, що відповідають цим числам. Кожен номер буде поєднання стабільного набору функцій, які виділять як окремий фактор. Останній шар неоконтейтрона містить стільки нейронів, як зображення повинні бути виявлені. Діяльність одного з нейронів даного шару свідчить про визнання відповідного зображення (рис. нижче).

Визнання в неоконенітроні (Fukushima K., Neocognitron, 2007)

Відео нижче дозволяє отримати чітку картину неоконтейтрона.

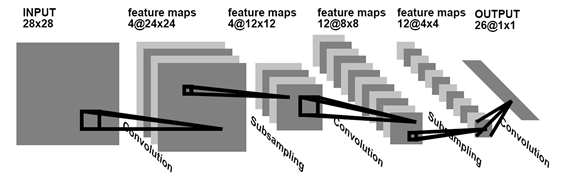

Альтернативою навчання без вчителя є навчання з викладачем. Отже, у прикладі чисел ми не можемо чекати самої мережі, щоб визначити статистично стабільні форми, але розповісти про те, що фігура представлена до неї і вимагати відповідного навчання. Найяскравіші результати в таких тренінгах зв’язаних мереж були досягнуті Ю. Лекунь та Є. Беніо (1995). Він продемонстрував, як метод зворотного пропагування помилки може бути використаний для поїздів мереж, архітектури яких, як і з неоконтейтрона, невагомо нагадує кору.

Мережа Convolution для розпізнавання рукопису (Y. LeCun і Y. Bengio, 1995)

Ми припустимо, що мінімальна початкова інформація нагадується і ми можемо переходити на речі цікавіше і дивовижне.

Продовження

Література використана

Попередні частини:

Частина 1. нейрон

Зареєструватися 2. Фактори

Олексій Редозув (2014)

Джерело: habrahabr.ru/post/214317/