623

Сценарії, які можуть призвести до розвитку штучного інтелекту

Нейролог і філософ Сам Харріс описує сценарії, які можуть здаватися страшними, але можуть статися з нами як різновиди. Дійсно, важко уявити, як штучна інтелект (AI) знищить нас, але все ж, є люди, які намагаються перенести майбутнє до сьогодення і прогнозувати подальші шляхи розвитку людини. І ось, що нам потрібно думати про те, як ми думаємо про те, що таке ж питання.

Що буде штучний інтелект вибрати, коли він зіткнувся з вибором?

Однією з основних проблем, які особа зіткнулася з розвитком AI, є те, як змусити обчислювальні системи, щоб зробити не тільки судові рішення, але і емоційні. Оскільки штучний інтелект може легко вбити всіх людей, щоб зберегти інші види. Це так само, як атакувати нож-провідникову тугу і витягувати гармату. І в той момент, замість того, щоб захистити свого власника, ваш лояльний собака буде атакувати вас просто, тому що у вас є більш небезпечна зброя в руках. . й

Що робити, якщо двері однакові? За дверима номер один... З огляду на те, що саме те, що буде працювати AI? Що може йти? Повнорозмірна ядерна війна? Глобальна пандемія? Чи стане Президентом Сполучених Штатів? Як ми знаємо, що AI може просто знищити цивілізацію. Сьогодні багато людей говорять, що суспільство стрімко погіршується. А що, якщо штучний інтелект вважає про це і вирішує, що буде легше знищити людство, а не продовжити технологічний розвиток, що тільки робить ситуацію гірше?

Що за дверима номер два?

Єдина альтернатива - ми продовжуємо вдосконалювати свій інтелектуальний машинний рік після року. На певній точці ми будуємо машини, які смартнери, ніж ми, і як тільки у нас є машини, які смартнери, ніж ми, вони почнуть покращувати себе. І тоді ми збираємо ризик створення «інтелектуального вибуху», і це процес може знищити нас. В даний момент ми будуємо машини, які набагато більш компетентні, ніж ми, що найменша дивергенція між своїми цілями і власними силами може призвести до нашої загальної руйнації як виду.

Твенті-перший століття комах Про те, як ми лікуємо мурах. Ми не даємо їх. Ми не будемо виходити з нашого способу завдати шкоди їм. Ми починаємо над цими маленькими працівниками, не звертаючи увагу на них, але коли їх присутність серйозно конфліктує з однією з наших цілей, скажемо, в будівництві будівлі ми знищуємо їх без найменшого гаманця. Про нас одноденні будівельні машини, які свідомо чи ні, можуть почати ласощі

Глибоке мислення, глибокий вплив Розвідка є результатом обробки інформації в фізичних системах. Ми вже створили вузький інтелект для наших машин, і багато хто з них виконує певні функції або навіть краще, ніж людина. Ми використовуємо для того, щоб захистити все, що ми цінуємо. Найцінніший ресурс. У нас є проблеми, які ми повинні вирішити. Хочу перемогти СНІД, цукровий діабет і рак. Ми хочемо, щоб побудувати дійсно робочі економіки. Ми хочемо покращити клімат на планеті. А що буде AI робити, якщо це просто не має такої речі, як глибоке мислення?

539240

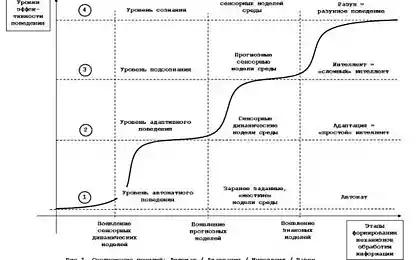

Де ми?

Не вдалося досягнути піку інтелекту. Дуже важливо розібратися. Ми можемо самі зателефонувати одержувачу і узгодити зручний час і місце вручення квітів. У більшості випадків потенціал людського інтелекту набагато більше, ніж ми в даний час реалізуємо. Що, якщо ми будували машини, які були розумними, ніж нам? Вони зможуть краще розрахувати майбутнє і краще визначити, де вони потрібні для того, щоб вибрати напрямок подальшого руху.

Швидкість інтелекту Уявіть, що людство побудувала суперінтелент AI, який не розумний, ніж середня група вчених. Єдина відмінність полягає в тому, що його електронні ланцюги працюють на мільйон разів швидше, ніж наші біохімічні речовини. В результаті цього агрегату «мийки» про мільйон разів швидше, ніж свідомість, яка побудувала його. Отже, залишаючи AI, що працює протягом тижня, ми знайдемо, що він зробив 20 000 років інтелектуальної праці в еквіваленті людини. Що ми робимо з такою швидкістю обробки даних? Щоб уповільнити швидкість AI до рівня людини?

Кращий сценарій справи Насправді, що ви і я піклуюся про те, як будуть розгортатися в ідеальному середовищі. Ми можемо самі зателефонувати одержувачу і узгодити зручний час і місце вручення квітів. Якби ми були, щоб створити видовище, яке бджоли точно так само призначене. Що ми отримуємо? Суть, ми створимо ідеальний рятувальний пристрій. Так ми говоримо про закінчення виснаженого людського існування. Великий Ми також можемо сказати, що створення такої машини буде закінченням всіх інтелектуальних робіт. Багато людей думають, що це добре, але запитайте себе, що відбудеться в цьому випадку. Вже зараз, з невеликим прогресом в AI, ми побачимо підвищення рівня нерівності та безробіття, які ми ніколи не бачили. Ми не готові ділитися нашим багатством з іншими, і, швидше за все, світ буде правильним за декількома трильйонерами, а решта людства буде повністю залежати від їх волі, а швидше за все, на волі AI під їх контролем, що буде діяти над раціонально без стяжки будь-якого.

The Next Arms Race

Уявіть, що кожна країна в світі має штучний інтелект, який обчислює ідеальний сценарій для перемоги глобальної війни. Якщо це війна на землі, в повітрі або навіть кіберневої війни, кожен зможе виграти. В суть АІ створить для кожного суперпотуження стратегії перемоги, яка з часом призведе до кінця людства, бо це буде війна штучного інтелекту проти людства.

«Не турбуйте або заплутайте свою гарну голівку з цими питаннями. . . ?

АІ створить нарцистичну рестаманську громаду. Не хвилюйтеся, будьте щасливими. Це те, що штучний інтелект говорить в дискусію, що робить життя простіше для нас сьогодні. Вже сьогодні ми відчуваємо, як штучний інтелект в його неспроможності робить нас тьмяними, і що відбудеться в 50 або 100 років, коли, як ми обіцяємо, вже буде штучним інтелектом перевершує людський інтелект. Якщо розвідник все про обробку інформації, і ми постійно вдосконалюємо наші машини, не думаємо, що ми вже створили надінтеллігію? Ми вже сьогодні не згадуємо, що штучний інтелект є небезпечним, таким як штучний інтелект навігаторах, що змушує людей їздити в промивання і стрибати в машині в озера. І я говорю про те, що ми маємо лише 50 років, щоб зіткнутися з головним ворогом людини - суперінтелігенція.

Технологія безпосередньо в мозок

Машини в майбутньому не можуть допомогти, але діляться нашими значеннями, оскільки вони буквально стануть розширенням себе. Вони будуть пришиті в наш мозок, і ми по суті станемо їх щелепною системою. Подумайте про те, що у вашому мозку можна прочитати інформацію і обробити її в алгоритмі, який ви не знаєте. Іноді ви не довіряєте мозок, і є чіпом. Але з появою суперінтелента А.І., тиснення чіпів у вашому мозку буде найбезпечнішим і найактуальним способом йти вперед. Але питання безпеки даних, які ми не можемо вирішити навіть сьогодні, змушує вас думати, що це якось неправильно.

Потрібно враховувати ці сценарії та діяти. Людство не має розв’язання проблеми штучного інтелекту, ми можемо запропонувати і просто рекомендувати. Людина повинна спочатку будувати AI за принципом «не завдати шкоди людству». Якщо ви поговорите про суперінтелентні AI, які можуть внести зміни до себе, то, здається, що для того, щоб розпочати роботу, ми як різновиди повинні вирішувати всі наші внутрішні проблеми, інакше ми будемо скомпробувати. Ми повинні визнати, що ми в процесі створення свого роду бога. Уявіть, що ви живете під дивним поглядом Бога, яким ви фізично відчуваєте, і що ви повинні піти, щоб визнати не церква, але до вашого мобільного пристрою. Видання

П.С. І пам'ятайте, що лише змінивши вашу свідомість – разом ми змінюємо світ!

Джерело: muz4in.net/news/kak_vygody_kotorye_my_poluchim_ot_sozdanija_iskusstvennogo_intellekta_mogut_v_konechnom_schete_unichtozhit_nas/2016-10-11-42148

Що буде штучний інтелект вибрати, коли він зіткнувся з вибором?

Однією з основних проблем, які особа зіткнулася з розвитком AI, є те, як змусити обчислювальні системи, щоб зробити не тільки судові рішення, але і емоційні. Оскільки штучний інтелект може легко вбити всіх людей, щоб зберегти інші види. Це так само, як атакувати нож-провідникову тугу і витягувати гармату. І в той момент, замість того, щоб захистити свого власника, ваш лояльний собака буде атакувати вас просто, тому що у вас є більш небезпечна зброя в руках. . й

Що робити, якщо двері однакові? За дверима номер один... З огляду на те, що саме те, що буде працювати AI? Що може йти? Повнорозмірна ядерна війна? Глобальна пандемія? Чи стане Президентом Сполучених Штатів? Як ми знаємо, що AI може просто знищити цивілізацію. Сьогодні багато людей говорять, що суспільство стрімко погіршується. А що, якщо штучний інтелект вважає про це і вирішує, що буде легше знищити людство, а не продовжити технологічний розвиток, що тільки робить ситуацію гірше?

Що за дверима номер два?

Єдина альтернатива - ми продовжуємо вдосконалювати свій інтелектуальний машинний рік після року. На певній точці ми будуємо машини, які смартнери, ніж ми, і як тільки у нас є машини, які смартнери, ніж ми, вони почнуть покращувати себе. І тоді ми збираємо ризик створення «інтелектуального вибуху», і це процес може знищити нас. В даний момент ми будуємо машини, які набагато більш компетентні, ніж ми, що найменша дивергенція між своїми цілями і власними силами може призвести до нашої загальної руйнації як виду.

Твенті-перший століття комах Про те, як ми лікуємо мурах. Ми не даємо їх. Ми не будемо виходити з нашого способу завдати шкоди їм. Ми починаємо над цими маленькими працівниками, не звертаючи увагу на них, але коли їх присутність серйозно конфліктує з однією з наших цілей, скажемо, в будівництві будівлі ми знищуємо їх без найменшого гаманця. Про нас одноденні будівельні машини, які свідомо чи ні, можуть почати ласощі

Глибоке мислення, глибокий вплив Розвідка є результатом обробки інформації в фізичних системах. Ми вже створили вузький інтелект для наших машин, і багато хто з них виконує певні функції або навіть краще, ніж людина. Ми використовуємо для того, щоб захистити все, що ми цінуємо. Найцінніший ресурс. У нас є проблеми, які ми повинні вирішити. Хочу перемогти СНІД, цукровий діабет і рак. Ми хочемо, щоб побудувати дійсно робочі економіки. Ми хочемо покращити клімат на планеті. А що буде AI робити, якщо це просто не має такої речі, як глибоке мислення?

539240

Де ми?

Не вдалося досягнути піку інтелекту. Дуже важливо розібратися. Ми можемо самі зателефонувати одержувачу і узгодити зручний час і місце вручення квітів. У більшості випадків потенціал людського інтелекту набагато більше, ніж ми в даний час реалізуємо. Що, якщо ми будували машини, які були розумними, ніж нам? Вони зможуть краще розрахувати майбутнє і краще визначити, де вони потрібні для того, щоб вибрати напрямок подальшого руху.

Швидкість інтелекту Уявіть, що людство побудувала суперінтелент AI, який не розумний, ніж середня група вчених. Єдина відмінність полягає в тому, що його електронні ланцюги працюють на мільйон разів швидше, ніж наші біохімічні речовини. В результаті цього агрегату «мийки» про мільйон разів швидше, ніж свідомість, яка побудувала його. Отже, залишаючи AI, що працює протягом тижня, ми знайдемо, що він зробив 20 000 років інтелектуальної праці в еквіваленті людини. Що ми робимо з такою швидкістю обробки даних? Щоб уповільнити швидкість AI до рівня людини?

Кращий сценарій справи Насправді, що ви і я піклуюся про те, як будуть розгортатися в ідеальному середовищі. Ми можемо самі зателефонувати одержувачу і узгодити зручний час і місце вручення квітів. Якби ми були, щоб створити видовище, яке бджоли точно так само призначене. Що ми отримуємо? Суть, ми створимо ідеальний рятувальний пристрій. Так ми говоримо про закінчення виснаженого людського існування. Великий Ми також можемо сказати, що створення такої машини буде закінченням всіх інтелектуальних робіт. Багато людей думають, що це добре, але запитайте себе, що відбудеться в цьому випадку. Вже зараз, з невеликим прогресом в AI, ми побачимо підвищення рівня нерівності та безробіття, які ми ніколи не бачили. Ми не готові ділитися нашим багатством з іншими, і, швидше за все, світ буде правильним за декількома трильйонерами, а решта людства буде повністю залежати від їх волі, а швидше за все, на волі AI під їх контролем, що буде діяти над раціонально без стяжки будь-якого.

The Next Arms Race

Уявіть, що кожна країна в світі має штучний інтелект, який обчислює ідеальний сценарій для перемоги глобальної війни. Якщо це війна на землі, в повітрі або навіть кіберневої війни, кожен зможе виграти. В суть АІ створить для кожного суперпотуження стратегії перемоги, яка з часом призведе до кінця людства, бо це буде війна штучного інтелекту проти людства.

«Не турбуйте або заплутайте свою гарну голівку з цими питаннями. . . ?

АІ створить нарцистичну рестаманську громаду. Не хвилюйтеся, будьте щасливими. Це те, що штучний інтелект говорить в дискусію, що робить життя простіше для нас сьогодні. Вже сьогодні ми відчуваємо, як штучний інтелект в його неспроможності робить нас тьмяними, і що відбудеться в 50 або 100 років, коли, як ми обіцяємо, вже буде штучним інтелектом перевершує людський інтелект. Якщо розвідник все про обробку інформації, і ми постійно вдосконалюємо наші машини, не думаємо, що ми вже створили надінтеллігію? Ми вже сьогодні не згадуємо, що штучний інтелект є небезпечним, таким як штучний інтелект навігаторах, що змушує людей їздити в промивання і стрибати в машині в озера. І я говорю про те, що ми маємо лише 50 років, щоб зіткнутися з головним ворогом людини - суперінтелігенція.

Технологія безпосередньо в мозок

Машини в майбутньому не можуть допомогти, але діляться нашими значеннями, оскільки вони буквально стануть розширенням себе. Вони будуть пришиті в наш мозок, і ми по суті станемо їх щелепною системою. Подумайте про те, що у вашому мозку можна прочитати інформацію і обробити її в алгоритмі, який ви не знаєте. Іноді ви не довіряєте мозок, і є чіпом. Але з появою суперінтелента А.І., тиснення чіпів у вашому мозку буде найбезпечнішим і найактуальним способом йти вперед. Але питання безпеки даних, які ми не можемо вирішити навіть сьогодні, змушує вас думати, що це якось неправильно.

Потрібно враховувати ці сценарії та діяти. Людство не має розв’язання проблеми штучного інтелекту, ми можемо запропонувати і просто рекомендувати. Людина повинна спочатку будувати AI за принципом «не завдати шкоди людству». Якщо ви поговорите про суперінтелентні AI, які можуть внести зміни до себе, то, здається, що для того, щоб розпочати роботу, ми як різновиди повинні вирішувати всі наші внутрішні проблеми, інакше ми будемо скомпробувати. Ми повинні визнати, що ми в процесі створення свого роду бога. Уявіть, що ви живете під дивним поглядом Бога, яким ви фізично відчуваєте, і що ви повинні піти, щоб визнати не церква, але до вашого мобільного пристрою. Видання

П.С. І пам'ятайте, що лише змінивши вашу свідомість – разом ми змінюємо світ!

Джерело: muz4in.net/news/kak_vygody_kotorye_my_poluchim_ot_sozdanija_iskusstvennogo_intellekta_mogut_v_konechnom_schete_unichtozhit_nas/2016-10-11-42148

Німеччина вирізати виробництво енергії вітру на половину

False fuss: як постійне працевлаштування знижує продуктивність