486

Штучний інтелект навчився описати мову людини, що він бачить

Спочатку комп'ютери дізналися про наші обличчя в фотографіях, і зараз вони здатні точно описати, що людина робить в певному образі.

Останній місяць, Інженери Google продемонстрували громадську мережу Deep Dream, яка може перетворювати зображення в фантастичні абстрактні бачення, але зараз вчені з Stanford презентували свій розвиток NeuralTalk, який здатний описати мову людини, що вона бачить.

НеуралТакл вперше згадувався минулого року. Розвиток цієї системи очолює директор лабораторії штучного інтелекту в Університеті Станфорда Фей-Фей Лі, а також його випускник Андрій Карпатський. Програма, написана в рамках проекту, здатна проаналізувати складний образ і визначити, що відбувається на ньому, описуючи все, що видно на розмовній мові людини.

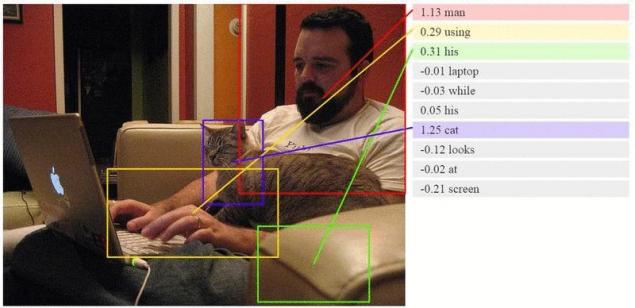

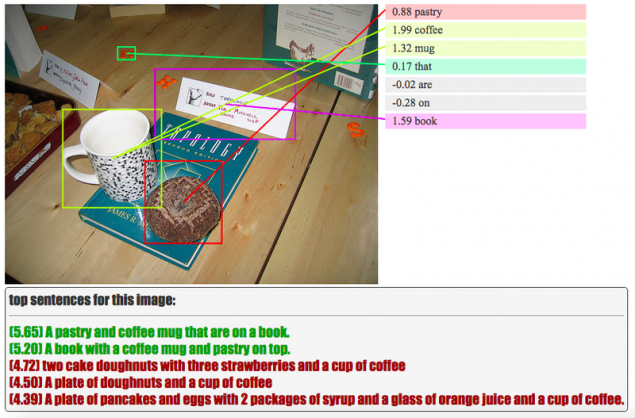

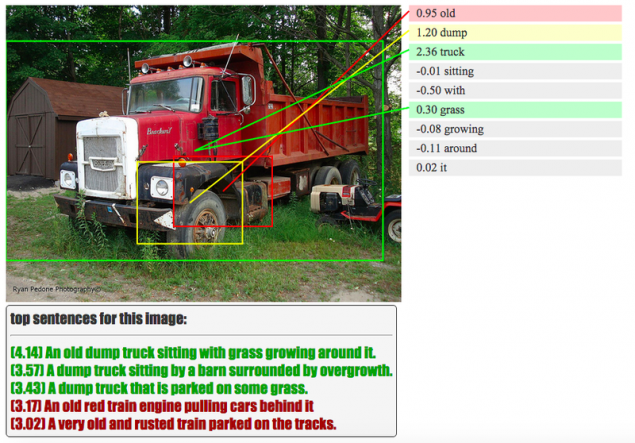

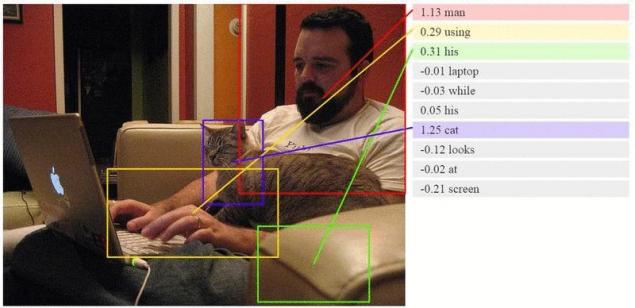

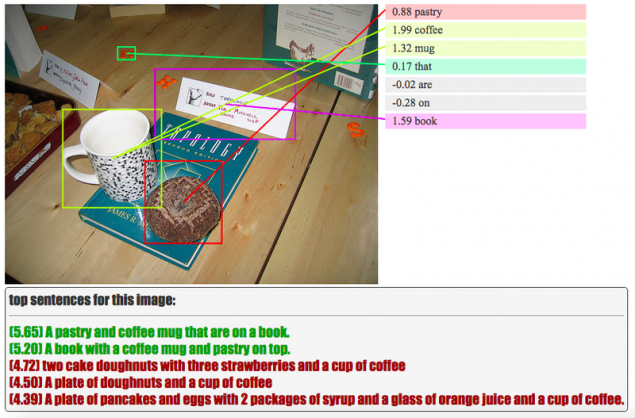

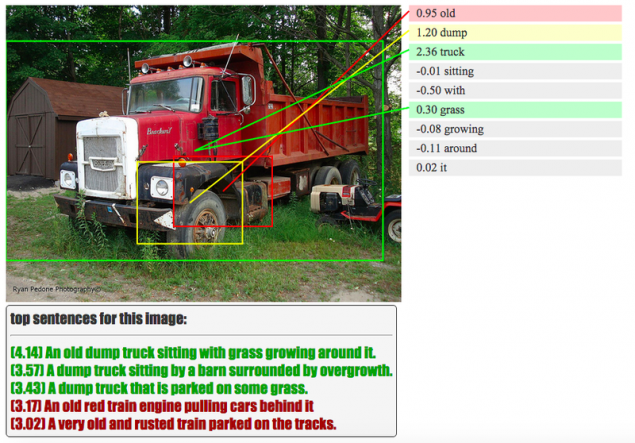

Наприклад, якщо фото зображено чоловіка в чорному футболці, граючи на гітарі, то штучний інтелект буде описати те, що він бачив: «Людина в чорному футболці грає гітару». Звісно, робота все ще триває, тому алгоритм часто викликає смішні помилки, але без цього в сучасному науці немає. Ви можете побачити нижче, що виглядає тестова версія алгоритму. АІ виглядає для окремих об'єктів, подій або дій в образі і призначає їх індивідуальні слова, в результаті складаючи їх в значуще вирок.

В той же час об'єкти позначені різними кольорами, в правильністі визнання яких штучний інтелект впевнений в одному або іншому. Ви можете переглянути процес вивчення штучного інтелекту на офіційному сайті дослідників.

Схожі системи Deep Dream, NeuralTalk використовує нейромережу. Алгоритм порівняння нового образу з попередньо побаченими фотографіями, як маленька дитина дізнається нові слова і запам'ятовує зображення об'єктів. Вчені неодноразово пояснюють штучний інтелект, який кішка, гамбургер або взуття виглядає так, і NeuralTalk запам'ятовує все це і майже точно визначає ці зображення в майбутньому.

Розробники будуть мати складну і дуже нудну роботу навчання для знань штучного інтелекту. Вони повинні повісити мільйони «ім'яних тегів» на різних об'єктах, що зображені в тисячі зображеннях до AI, можуть самостійно описати зображення і ситуації, показано на ній. Для початківців вчені сподіваються, що вони зможуть створити пошуковий двигун, який в даний момент може знайти зображення, яке цікавиться величезними просторами Інтернету.

У майбутньому така нейромережа може зробити більше. Наприклад, цей алгоритм може знайти не тільки фотографію, але і той момент, що ви зацікавлені в кіно, серіалі або відео YouTube. Видання

P.S. І пам'ятайте, що просто змініть наше споживання – разом ми змінюємо світ!

Джерело: hi-news.ru

Останній місяць, Інженери Google продемонстрували громадську мережу Deep Dream, яка може перетворювати зображення в фантастичні абстрактні бачення, але зараз вчені з Stanford презентували свій розвиток NeuralTalk, який здатний описати мову людини, що вона бачить.

НеуралТакл вперше згадувався минулого року. Розвиток цієї системи очолює директор лабораторії штучного інтелекту в Університеті Станфорда Фей-Фей Лі, а також його випускник Андрій Карпатський. Програма, написана в рамках проекту, здатна проаналізувати складний образ і визначити, що відбувається на ньому, описуючи все, що видно на розмовній мові людини.

Наприклад, якщо фото зображено чоловіка в чорному футболці, граючи на гітарі, то штучний інтелект буде описати те, що він бачив: «Людина в чорному футболці грає гітару». Звісно, робота все ще триває, тому алгоритм часто викликає смішні помилки, але без цього в сучасному науці немає. Ви можете побачити нижче, що виглядає тестова версія алгоритму. АІ виглядає для окремих об'єктів, подій або дій в образі і призначає їх індивідуальні слова, в результаті складаючи їх в значуще вирок.

В той же час об'єкти позначені різними кольорами, в правильністі визнання яких штучний інтелект впевнений в одному або іншому. Ви можете переглянути процес вивчення штучного інтелекту на офіційному сайті дослідників.

Схожі системи Deep Dream, NeuralTalk використовує нейромережу. Алгоритм порівняння нового образу з попередньо побаченими фотографіями, як маленька дитина дізнається нові слова і запам'ятовує зображення об'єктів. Вчені неодноразово пояснюють штучний інтелект, який кішка, гамбургер або взуття виглядає так, і NeuralTalk запам'ятовує все це і майже точно визначає ці зображення в майбутньому.

Розробники будуть мати складну і дуже нудну роботу навчання для знань штучного інтелекту. Вони повинні повісити мільйони «ім'яних тегів» на різних об'єктах, що зображені в тисячі зображеннях до AI, можуть самостійно описати зображення і ситуації, показано на ній. Для початківців вчені сподіваються, що вони зможуть створити пошуковий двигун, який в даний момент може знайти зображення, яке цікавиться величезними просторами Інтернету.

У майбутньому така нейромережа може зробити більше. Наприклад, цей алгоритм може знайти не тільки фотографію, але і той момент, що ви зацікавлені в кіно, серіалі або відео YouTube. Видання

P.S. І пам'ятайте, що просто змініть наше споживання – разом ми змінюємо світ!

Джерело: hi-news.ru