234

Кевін Абош: Етичні основи штучного інтелекту

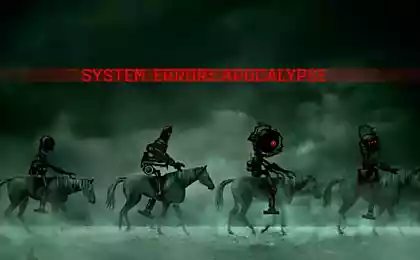

Ідея, що штучний інтелект неминуче призведе до сценарію, в якому машини повстанці проти людини досить популярна. Штучна супервзір'я здається найбільшою можливою загрозою, і фантастичними сюжетами, які кажуть, що нам не буде потрібно в світі, що належить технології, ніколи не втратили популярність.

Чи є це неминуче? Літературно-архітектурне зображення інтелектуальних комп’ютерних систем від «60-х рр. допомогло формувати та узагальнити наші очікування майбутнього, як ми поглиблюємо шлях до створення машинного інтелекту перевершує людський інтелект. АІ, очевидно, вже перетворена людина в певних конкретних задачах, які вимагають складних обчислень, але все ж відстає за низкою інших можливостей. Як одночасно збільшити потужність цього суворого інструмента і підтримувати нашу економічну позицію над нею.

З штучним інтелектом вже грає, і продовжить грати, велику роль в нашому майбутньому, критично важливо вивчити наші можливості співіснування з цими складними технологіями.

Кевін Абош, засновник компанії Kwikdesk, який займається обробкою даних і розвитком штучного інтелекту, поділився думками про це питання. Він вважає, що штучний інтелект повинен бути швидким, невидимимим, надійним, компетентним і етичним. Так, етичний.

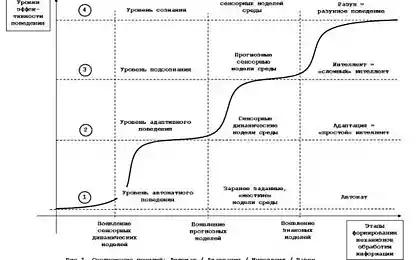

Концепція штучної нейромережі, створеної в подобанні біологічної нейромережі, нічого нового. Блоки обчислювальної потужності, які називають нейронами, з'єднуються між собою і утворюють мережу. Кожна нейрона стосується комплексного алгоритму навчання при вході до передачі даних іншим нейронам, доки нейрон активується на виході і відкриває можливість читання. Експертні системи спираються на людей, щоб «вчити» систему шляхом посіву насіння знань. Технології логічної обробки дивляться на кореспонденції, роблять вибір і налаштовують «якщо це, то» правила щодо бази знань. У цьому процесі до бази знань додано нові знання. Чистий нейромережа дізнається в процесі отримання нелінійного досвіду, не має проблем сівби знань експертом. Гібридні мережі довели для покращення можливостей машинного навчання.

Тепер розглянемо етичні проблеми цих систем. Від першої особи.

Автор використовує слова для занурення читача в фантастичному світі, і робить його різними способами, але великі автори роблять це дуже витончено. Інженер програмного забезпечення пише лінії коду, що полегшує обробку даних та переміщення даних. Він теж може вибрати з ряду варіантів різних способів, але елегантні кодери - народи комп'ютерної науки. Привабливий енкодер фокусується на тому, як включити якомога більше і краще в найкоротший і витончений код. Додатковий код зберігається до мінімуму. Великий код також зберігає відкритий вікно для наступних доповнень. Інші інженери можуть додавати код з їх властивою елегантністю, і продукт розвивається безшовно.

На серці будь-якого виробу, що виготовлений вручну. Речі, зроблені людьми, перевозяться з намірами, і на один ступінь або інший, є носіями дуже природи творця. Деякі люди важко уявити об'єкт, який об'єднує такий характер. Але багато хто згодні. Енергія наміру існувала на тисячу років, окреслює, поділяє, об’єднує, трансформує суспільство. Не може бути застарілою. Пам'ятайте, що рядки коду написані на певній мові програмування. Я переконаний, що код, який стає програмним забезпеченням, що використовується на комп'ютерах або мобільних пристроях, дуже "живий".

Не розглядаючи мудрість і духовність в контексті комп’ютерної науки і потенційних наслідків штучного інтелекту, ми все одно можемо бачити статичний код як один з потенціалом, щоб зробити хороший або злий. Ці вихідні знаходять себе тільки в процесі використання додатків людьми. Це чіткий вибір людей, які впливають на природу додатку. Вони можуть бути розглянуті в локальній системі, що визначає позитивний або негативний вплив на цю систему, або на основі встановлених стандартів. Однак, як журналіст не може бути 100% неупередженим в процесі написання статті, тому інженер буде чи безперечно додає характер своїх намірів до коду. Деякі можуть сперечатися, що написання коду є логічним процесом, і реальна логіка не залишає місця для природи.

Але я впевнений, що ми створюємо правило, блок коду, або весь код, це все, що надіслав елемент людської природи. З кожним додатковим правилом проникненням прогенових глибень. Більш складний код, чим більше цього характеру є. «Чи може природа коду бути добре або зло? й

Очевидно, що вірус, розроблений хакером, який зловмисно розривається через захист комп'ютерів і злаків гавок на вашому житті, злий характер. Але що про вірус, створений «добрими хлопцями» для інфільтрації комп’ютерів терористичної організації для запобігання нападів терористів? Що таке його природа? Технічно, він може бути ідентичним його незліченним аналогом, тільки використовується для цілей «добрих». Так його природа добре? Це етичний парадокс шкідливих програм. Але ми не змогли ігнорувати код «evil».

На мою думку, є код, який властиво з'єднатися до «спів,» і є код, який властиво benevolent. Це важливіше в контексті офлайнових комп’ютерів.

На Kwikdesk ми розробляємо AI-фреймворк і протокол на основі мого дизайну експертної системи/гібридної нейромережі, яка найбільше нагадує біологічну модель, створену на сьогоднішній день. Нейрони з'являються як вхідні / вихідні модулі та віртуальні пристрої (у сенсі автономні агенти), підключені «віссонами», захищеними, відокремленими каналами зашифрованих даних. Дані розшифровані як він надходить в нейрон і, після певних процесів, зашифровані перед відправкою в наступний нейрон. Перед тим як нейрони можуть спілкуватися один з одним через аксон, має бути обмін учасниць і каналів ключів.

Я вірю, що безпека і поділ повинні бути побудовані в такі мережі з найнижчого рівня. Додатки відображають якості своїх найменших компонентів, тому що все менше, ніж безпечні будівельні блоки призведе до того, щоб працювати безпечно. З цієї причини дані повинні бути захищені локально і розшифровані в локальній передачі.

Якість наших життів разом з машинами, які отримують смартнер і смартер, зрозуміло, що ми повинні прийняти дії, щоб забезпечити здорове майбутнє для поколінь. Погрози смарт-машина потенційно різноманітні, але можуть бути розбиті в наступні категорії:

Бронювання На робочому місці люди будуть замінені вагонами. Цей перехід відбувався протягом десятиліть і буде тільки прискорюватися. Освіта необхідна для підготовки людей до майбутнього, в яких сотні мільйонів традиційних робочих місць просто перестануть існувати. Складний.

Безпека. Ми повністю перейдемо на верстатах і продовжуємо спиратися. Як ми все частіше довіряємо машини, як ми переїжджаємо з зони безпеки до потенційної небезпеки, ми можемо зіткнутися з ризиком помилки машини або шкідливого коду. Подумайте про перевезення, наприклад.

Здоров'я. Особисті діагностичні пристрої та мережеві медичні дані. АІ продовжить завчасно в профілактичній медицині та переповненому генетичному аналізі даних. Знову ми повинні мати гарантії, що ці машини не будуть залучені до шкідливої підверсії або завдати шкоди нам будь-яким чином.

Фат. AI прогнозує з підвищенням точності, де ви будете йти і що ви будете робити. Ми знаємо, які рішення ми робимо, де ми будемо йти на наступний тиждень, які продукти ми будемо купувати або навіть коли вмираємо. Ми хочемо, щоб інші могли отримати доступ до даних?

Знання. Машини де-факто накопичують знання. Як ми довіряємо свою цілісність?

У висновку, що в технологічному суперновому вибухі є пильним і відповідальним підходом до штучного інтелекту. Ми можемо самі зателефонувати одержувачу і узгодити зручний час і місце вручення квітів, а якщо необхідно, то збережемо сюрприз.

Джерело: hi-news.ru

Як виростити щорічні китайські айстри: вирощування з насіння в відкритому грунті.

Ідеї для оформлення клумб і клумб