222

Kevin Abosch: El marco ético de la inteligencia artificial

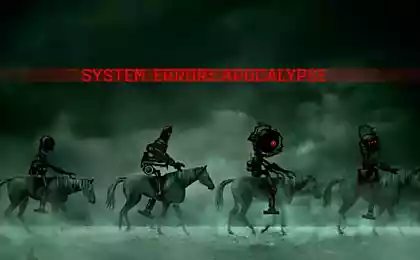

La idea de que la inteligencia artificial inevitablemente nos llevará a un escenario en el que las máquinas se rebelan contra los humanos es bastante popular. La superinteligencia artificial parece ser la mayor amenaza posible, y conspiraciones fantásticas que dicen que no será necesario en un mundo de propiedad de la tecnología nunca han perdido popularidad.

¿Eso es inevitable? La representación literaria y cinematográfica de los sistemas informáticos inteligentes de los años 60 ayudó a configurar y generalizar nuestras expectativas del futuro mientras nos embarcamos en un camino hacia la creación de la inteligencia de la máquina superior a la inteligencia humana. Amnistía Internacional obviamente ya ha superado a los seres humanos en ciertas tareas específicas que requieren computaciones complejas, pero todavía está atrasada en varias otras capacidades. Cómo aumentar simultáneamente el poder de este duro instrumento y mantener nuestra posición económica sobre él.

Con la inteligencia artificial ya jugando, y seguirá desempeñando, un gran papel en nuestro futuro, es fundamental explorar nuestras posibilidades de coexistir con estas complejas tecnologías.

Kevin Abosch, fundador de Kwikdesk, que se dedica al procesamiento de datos y al desarrollo de la inteligencia artificial, compartió sus pensamientos sobre este asunto. Cree que la inteligencia artificial debe ser rápida, invisible, confiable, competente y ética. Sí, ética.

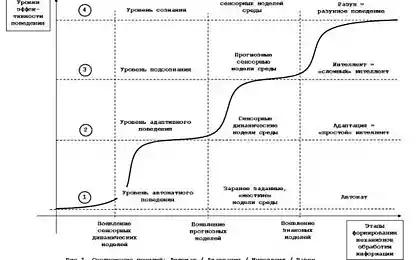

El concepto de una red neuronal artificial, creada en la semejanza de una red neuronal biológica, no es nada nuevo. Unidades de poder computacional, llamadas neuronas, se conectan entre sí y forman una red. Cada neurona aplica un complejo algoritmo de aprendizaje en la entrada antes de transferir los datos a otras neuronas hasta que la neurona se activa en la salida y abre la posibilidad de leer. Los sistemas de expertos dependen de las personas para “enseñar” el sistema al sembrar las semillas del conocimiento. Los mecanismos de procesamiento lógico buscan correspondencias, toman decisiones y establecen reglas “si esto, entonces” en relación con la base de conocimientos. En este proceso se añaden nuevos conocimientos a la base de conocimientos. Una red neuronal pura aprende en el proceso de obtener experiencia no lineal, no tiene problemas de siembra del conocimiento por un experto. Las redes híbridas han demostrado mejorar las capacidades de aprendizaje automático.

Veamos ahora los temas éticos de estos sistemas. De la primera persona.

El autor utiliza palabras para sumergirse en el lector en un mundo ficticio, y lo hace de diferentes maneras, pero los grandes autores lo hacen con mucha gracia. Un ingeniero de software escribe líneas de código que facilitan el procesamiento y movimiento de datos. Él, también, puede elegir entre una serie de opciones diferentes maneras, pero codificadores elegantes - gente de la ciencia de la computadora. El encoder que avanza se centra en cómo incorporar tanto y mejor como sea posible en código corto y agraciado. El código extra se mantiene al mínimo. El gran código también mantiene una ventana abierta para las adiciones posteriores. Otros ingenieros pueden añadir código con su elegancia inherente, y el producto se desarrolla sin problemas.

En el corazón de cualquier producto hecho por el hombre es la intención. Las cosas hechas por las personas están impregnadas de intenciones, y en un grado u otro son portadores de la misma naturaleza del creador. Algunas personas encuentran difícil imaginar un objeto inanimado con tal naturaleza. Pero muchos están de acuerdo. La energía de la intención ha existido durante miles de años, unifica, divide, une, transforma la sociedad. El poder del lenguaje no puede subestimarse. Recuerde que las líneas de código están escritas en un lenguaje de programación específico. Como tal, estoy convencido de que el código que se convierte en software utilizado en computadoras o dispositivos móviles es muy "vivo".

Sin considerar la sabiduría y la espiritualidad en el contexto de la ciencia informática y las posibles consecuencias de la inteligencia artificial, todavía podemos ver el código estático como uno con el potencial para hacer el bien o hacer el mal. Estos productos sólo se encuentran en el proceso de utilización de aplicaciones por personas. Son las opciones claras que la gente hace que afectan la naturaleza de la aplicación. Pueden considerarse en un sistema local, determinando el impacto positivo o negativo en ese sistema, o basándose en un conjunto de normas predeterminadas. Sin embargo, al igual que un periodista no puede ser 100% imparcial en el proceso de escribir un artículo, por lo que un ingeniero agrega voluntariamente o sin darse cuenta la naturaleza de sus intenciones al código. Algunos podrían argumentar que el código de escritura es un proceso lógico, y la lógica real no deja espacio para la naturaleza.

Pero estoy seguro de que en el momento en que creas una regla, un bloque de código, o un código entero, todo está impregnado de un elemento de la naturaleza humana. Con cada regla adicional, la penetración de la progenie se profundiza. Cuanto más complejo sea el código, más de esta naturaleza hay. Esto plantea la pregunta: ¿Puede la naturaleza del código ser buena o mala? ”

Obviamente, un virus desarrollado por un hacker que rompe malintencionadamente a través de las defensas de su computadora y arruinó el caos en su vida está impregnado de naturaleza maligna. Pero ¿qué hay de un virus creado por los “buenos” para infiltrar las computadoras de una organización terrorista para prevenir ataques terroristas? ¿Cuál es su naturaleza? Técnicamente, puede ser idéntico a su homólogo nefasto, usado sólo para fines “buenos”. ¿Entonces su naturaleza es buena? Esta es la paradoja ética del malware. Pero no podíamos ignorar el código "evil".

En mi opinión, hay un código que está inherentemente sesgado hacia el “mal” y hay un código que es inherentemente benevolente. Esto es más importante en el contexto de las computadoras fuera de línea.

324529

En Kwikdesk, estamos desarrollando un marco y protocolo de IA basado en mi diseño de un sistema experto/red neuronal híbrida que más se asemeja a un modelo biológico creado hasta la fecha. Las neuronas aparecen como módulos de entrada/salida y dispositivos virtuales (en cierto sentido, agentes autónomos) conectados por “axones”, canales seguros y separados de datos cifrados. Estos datos se descifran al entrar en una neurona y, después de ciertos procesos, se encriptan antes de ser enviados a la siguiente neurona. Antes de que las neuronas puedan comunicarse entre sí a través del axón, debe haber un intercambio de participantes y claves de canal.

Creo que la seguridad y la separación deben incorporarse en esas redes desde el nivel más bajo. Los complementos reflejan las cualidades de sus componentes más pequeños, por lo que cualquier cosa más pequeña que los bloques de construcción seguros hará que toda la línea funcione inseguramente. Por esta razón, los datos deben ser protegidos localmente y descifrados en la transmisión local.

La calidad de nuestras vidas junto con máquinas que se están volviendo más inteligentes y inteligentes es comprensiblemente preocupante, y estoy absolutamente seguro de que debemos tomar medidas para asegurar un futuro saludable para las generaciones venideras. Las amenazas de las máquinas inteligentes son potencialmente diversas, pero pueden dividirse en las siguientes categorías:

Reserva. En el lugar de trabajo, la gente será reemplazada por autos. Este cambio ha estado sucediendo durante décadas y sólo acelerará. Se necesita educación para preparar a las personas para un futuro en el que cientos de millones de empleos tradicionales simplemente dejarán de existir. Es complicado.

Seguridad. Confiamos totalmente en máquinas y seguiremos confiando. A medida que cada vez más confiamos en las máquinas a medida que pasamos de una zona segura a una zona de peligro potencial, podemos enfrentar el riesgo de error de máquina o código malicioso. Piense en el transporte, por ejemplo.

Salud. Dispositivos de diagnóstico personal y datos médicos de red. Amnistía Internacional seguirá avanzando en la medicina preventiva y en el análisis de datos genéticos con recursos múltiples. De nuevo, debemos tener seguridades de que estas máquinas no se involucrarán en subversión maliciosa o nos dañarán de ninguna manera.

Fate. AI predice con cada vez más precisión donde irás y lo que harás. A medida que esta industria evoluciona, sabrá qué decisiones tomamos, dónde iremos la próxima semana, qué productos compraremos o incluso cuando muramos. ¿Queremos que otros tengan acceso a estos datos?

Conocimiento. Máquinas de hecho acumulan conocimiento. Pero si adquieren conocimiento más rápido que los humanos pueden probarlos, ¿cómo podemos confiar en su integridad?

En conclusión, un enfoque vigilante y responsable de la IA para mitigar posibles problemas en una explosión tecnológica de supernova es nuestro camino. O domaremos el potencial de la IA y rezaremos para que sólo traiga lo mejor a la humanidad, o quemaremos en su potencial, lo que reflejará lo peor en nosotros.

Fuente: hi-news.ru

Cómo cultivar plantas anuales chinos aster: el cultivo de las semillas en el exterior.

Ideas de la formalizacin de los macizos de flores y setos