592

El científico stuart russell acerca de la inteligencia artificial

Veintiún millón cien noventa y ún mil seiscientos ochenta y siete

En enero de britano-americana de un científico de computación stuart russell fue el primero que firmó una carta abierta, en la que se instaba investigadores a reflexionar más profundamente acerca de su deseo de crear una inteligencia artificial superior y superior. "Recomendamos la realización de estudios avanzados para garantizar la seguridad y la sociabilidad de los sistemas de ia, cada vez con mayor potencia, — se indica en la carta. — Nuestros sistemas de ia, debemos hacer lo que queremos que hagan".

Miles de personas han firmado esta carta, incluyendo los principales investigadores de la inteligencia artificial de Google, Facebook, Microsoft y otros centros industriales, así como líderes de la computación de científicos, físicos y filósofos de todo el mundo. A finales de marzo, del orden de 300 grupos de investigación han comenzado a llevar a cabo nuevas investigaciones sobre la "conservación de la buena voluntad de la inteligencia artificial" en la herramienta de 37 firmante de la carta, el inventor-empresario elona la Máscara.

Russell, de 53 años, es profesor de ciencias de la computación y el fundador del Centro de sistemas inteligentes de la universidad de california en berkeley y hace mucho tiempo que estudia el poder y el peligro de los pensadores de la máquina. Es autor de más de 200 obras y un tutorial en este ámbito, "inteligencia Artificial: un enfoque moderno" (en colaboración con peter Норвигом). Sin embargo, un rápido progreso en el ámbito de la ia ha dado a los viejos temores a russell una importante relevancia.

En el último tiempo, dice él, la inteligencia artificial ha logrado un gran éxito, en parte gracias a los algoritmos de нейронного de aprendizaje. Se utilizan en el software de reconocimiento de caras de Facebook, personales y asistentes de ventas de smartphones y autodidactas, los coches de Google. No hace mucho, en todo el mundo прогремела red de neuronas artificial, que ha aprendido a jugar a los videojuegos de Atari mejor persona por un par de horas, tomando como base sólo los datos presentados en la pantalla, y el objetivo es marcar el máximo de puntos — no hay preprogramados de conocimientos sobre инопланетянах, cartuchos, derecho, izquierda, abajo, arriba.

"Si su bebé recién nacido lo ha hecho, podríamos pensar que está obsesionado", dice russell.

El registro de Quanta Magazine tomó el russell entrevista durante el desayuno en el encuentro Americano de física de la comunidad en marzo de 2015, en san antonio, texas, por la noche antes de que él iba a hablar sobre el futuro de la inteligencia artificial. En este tratado y ужатой versión de la entrevista russell reflexiona sobre la naturaleza de la inteligencia y sobre el rápido acercamiento a los problemas relacionados con la seguridad de las máquinas.

Usted piensa que el objetivo de su área — desarrollo de la inteligencia artificial, que "la posesión de la mente estrecha" con los valores humanos. Lo que esto significa?

Deliberadamente provocativa declaración, ya que la combinación de las dos cosas — "causa" y "valores humanos" ya de por sí es contradictorio. Bien puede ser que los valores humanos seguirán siendo un misterio para siempre. Pero de la misma manera, como estos valores se dan a conocer a nuestro comportamiento, usted puede esperar que la máquina será capaz de "tomar" la mayoría de ellos. En las esquinas se pueden quedar los trozos y piezas que la máquina no entiende o que no somos capaces de encontrar un consenso entre los mismos. Pero mientras que la máquina responda de la correcta requisitos, usted será capaz de mostrar que ella es inofensivo.

Cómo vas a lograr eso?

He aquí sobre qué tema, yo ahora trabajo: en qué punto de la máquina recibirá lo más parecidas posible a los valores a los que la gente necesita? Creo que una respuesta puede ser una técnica denominada "inversa de la educación con terminal". La enseñanza de la inmovilización es el proceso, cuando usted consigue las recompensas y los castigos, y su objetivo es llevar el proceso hasta obtener el máximo número de premios. Esto hace que el sistema de DQN (que juega en Atari); ella recibe una cuenta de juego, y su objetivo es hacer que esta cuenta anteriormente. Inversa de la educación con terminal de otra forma. Usted ve una especie de comportamiento y tratando de comprender lo que cuenta es el comportamiento de la trata de aumentar. Por ejemplo, su robot casero ve que en la mañana выползаете de la cama para echar un extraño color marrón círculo en la ruidosa máquina de hacer una intervención con el vapor y el agua caliente, la leche y el azúcar, y después mira feliz. El sistema determina que una parte importante de valor para el hombre — para obtener un café de la mañana.

En los libros, las películas y en internet hay una gran cantidad de información acerca de las acciones humanas y las relaciones, a la acción. Es increíble la base de datos para las máquinas que aprenden los valores de la gente — que recibe las medallas, que sale por la rejilla y por qué.

Cómo te iniciaste en el ámbito de la inteligencia artificial?

Cuando estaba en la escuela, en la ia no era considerado como disciplina académica en general. Pero yo estudiaba en un internado en londres, y tuve la oportunidad de acudir a la obligatoriedad de rugby, haciendo de informática de la ciencia en el vecino colegio. Uno de mis proyectos era un programa que aprende a jugar tic-tac-toe. He perdido toda la popularidad, ya que se sentó en la computadora del colegio hasta el final. En el siguiente año escribí un programa de ajedrez y ha recibido el permiso de uno de los profesores del colegio en el uso de su gigante мэйнфреймового equipo. Era increíble tratar de averiguar cómo enseñarle a jugar al ajedrez.

Sin embargo, todo esto es sólo un hobby; en ese momento mi académica era la física. Me ocupaba de la física en oxford. Y cuando luego me ha apartado de estudios de postgrado, se inclinó en el teórico de la física en oxford y cambridge y en ciencias de la computación en la universidad de massachusetts y stanford, sin darse cuenta de que perdí todos los plazos para la presentación en los estados unidos. Afortunadamente, stanford наплевал en los plazos, por lo que he pasado en él.

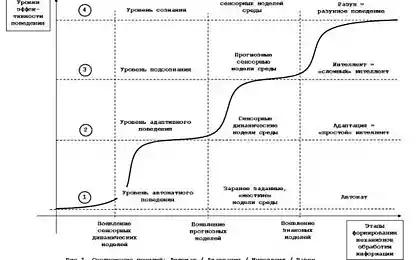

Durante su carrera, ha pasado mucho tiempo tratando de entender lo que es la inteligencia como condición necesaria, que pueden comprender y alcanzar la máquina. Lo que has aprendido?

Durante mi диссертационного de la investigación en la década de los 80, empecé a pensar en la gestión de la toma de decisiones y sobre el problema de la práctica de la imposibilidad de la misma. Si usted estuviera son racionales, sería pensaban: este es mi estado actual, éstos son los pasos que puedo hacer, entonces puedo hacer esto, luego esto; de qué manera se garantiza me llevará a la meta? La definición de la ordenación de la conducta exige la optimización de todo el futuro del Universo. Esto es imposible desde el punto de vista de los cálculos.

No tiene sentido tratar de encuadrar en ia imposible, por lo que empecé a pensar de otra forma: como en el casos en que tomamos decisiones?

Bueno, ¿y cómo?

Uno de los trucos es pensar en el corto plazo y, a continuación, asumir, de cómo podría lucir futuro más próximo. De ajedrez del programa, por ejemplo, si se racionales, realizando exclusivamente de los movimientos de garantizar el mate, pero ellos mismos no lo hacen. En lugar de ello, se cuentan decenas de movimientos hacia adelante y hacen suposiciones acerca de lo útil que estos próximos estado y, a continuación, toman las decisiones que conducen a uno de los mejores de estado.

El otro, que es importante no olvidar que se trata de un problema de decisiones en varios niveles de abstracción, "jerárquica de toma de decisiones". Una persona comete orden de 20 billones de acción física por su vida. Para llegar a esta conferencia y decirle que lo llevó a cometer los 1,3 millones de acciones más o menos. Si fueran racionales, que se habría tratado de calcular todos los 1,3 millones de pasos que, de hecho, es completamente imposible. La gente hace esto, gracias a la enorme equipaje abstractos de acción de alto nivel. Usted no piensa, "cuando voy a casa, voy a poner la pierna izquierda o la derecha en la alfombra, y luego podré esto y esto y esto". Usted piensa, "voy a ir a la tienda y comprar el libro. Luego de la llamada de taxis". Y todo. En general, usted no está particularmente, no necesita aclaración de piezas complejas. Como vivimos en un principio. El futuro borrosa, muchas de las piezas están cerca de nosotros en el tiempo, pero está representada principalmente por grandes piezas como "obtener el grado de", "tener hijos".

¿Los ordenadores en la actualidad son capaces jerárquica de la toma de decisiones?

Este es uno de los faltantes de piezas de rompecabezas ahora: ¿de dónde proceden todas estas acciones en un nivel alto? No creemos que programas como la red de DQN tienen abstracto de la presentación de actividades. Hay muchos juegos que DQN simplemente no entiende, y estos juegos compleja, que requiere muchos pasos computacional de antemano, en la forma de los conceptos primitivos de acción, es algo así como cuando un hombre piensa "lo que necesito para abrir la puerta?", y la apertura de la puerta incluye la extracción de la llave y así sucesivamente. Si el equipo no tiene esa forma de "abrir la puerta", ella no puede hacer nada.

Pero si esto no es un problema — y es muy posible — entonces veremos ordinario de un importante crecimiento de la capacidad de las máquinas. Hay dos o tres problemas, y si logras resolverlos, entonces me pregunto, esto es, si todavía grandes obstáculos a la ia del nivel humano.

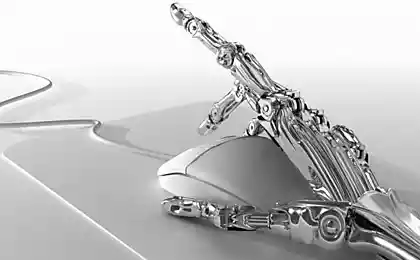

Lo que les molesta en la posibilidad de la aparición de la ia nivel humano?

En la primera edición de mi libro (1994), existe una sección de "¿y si nos pasa?", porque me parecía que las personas no reflexionan acerca de este especial. Tal parecía demasiado lejano, несбыточным. Pero, evidentemente, la misma que el éxito se convertirá en un gran evento. "El evento más grande en la historia de la humanidad", probablemente así se puede describir. Y si es así, entonces tenemos que pensar en lo que hacemos, para perfeccionar la forma de un posible evento.

La idea básica de la explosión de la inteligencia consiste en que, una vez que la máquina ha alcanzado un determinado nivel de inteligencia, son capaces de trabajar en la ia, así como nosotros, y mejorar sus propias características — la reprogramación de sí mismo y cambiar el relleno y su inteligencia va a crecer, no por días, sino por horas. En los últimos años la comunidad poco a poco отточило sus argumentos acerca de por qué esto puede ser un problema. La forma más convincente el argumento puede consistir en la ecuación de valores: se construye el sistema, que es extraordinariamente bueno en la optimización de funciones útiles, pero es un concepto de utilidad es cuestionable. El filósofo de oxford, Nick bostrom da el ejemplo con un clip. Usted dice "haz un par de grapas", y finalmente a todo el planeta resulta ser el almacén de las grapas. Usted construye сверхоптимизатор, pero útil, que se puede premiar, bien puede llegar a ser inútil.

¿Qué pasa con las diferencias en los valores humanos?

Es un problema interno. Se puede decir, la máquina debe ir a un lado y no hacer nada en las zonas donde puede surgir un conflicto de valores. Y esto es una tarea difícil. Creo que tenemos que crear en el sistema de valores. Si usted necesita un robot casero, él debe ser capaz de orientarse bien en los valores humanos; en caso contrario, va a hacer cosas estúpidas, que coloca al gato en el horno, ya que en la nevera hay comida, y los niños tienen hambre. La vida real está llena de tales compromisos. Si la máquina va tales concesiones y ha revelado que ella es algo que no se entiende es algo que obviamente la gente, — apenas si quieres tal coche a casa.

Yo no veo ningún camino real de creación de una especie de la industria de valores. Y también creo que tiene un gran incentivo económico para su creación. Robot casero hará una de dos cosas correctamente — como el gato asado en el horno y la gente al instante de perder su credibilidad.

Surge la pregunta de si vamos a enseñar a sistemas inteligentes de comportarse correctamente, a medida que la transición a la más razonable sistemas se si significa que vamos a recibir el mejor sistema de valores, limpiado de tontos momentos, o de la máquina que aún se выкаблучиваться? Tengo hasta el momento no hay respuesta a esta pregunta.

Dijiste que debemos comprobar matemáticamente el comportamiento de la ia en todas las circunstancias posibles. Como esto va a funcionar?

Una de las dificultades a las que apuntan los hombres, en que el sistema puede arbitrariamente producir una nueva versión de sí mismo, que serán otros objetivos. Es uno de los escenarios sobre los que constantemente dicen los escritores de la ciencia ficción: ¿de qué manera la máquina se obtiene el objetivo de destruir a la raza humana. La pregunta es: ¿puede usted demostrar que su sistema nunca, no importa cuán inteligentes no se, no se copiarán originales de los objetivos establecidos trata de personas?

Sería relativamente fácil demostrar que el sistema de DQN, siendo escrita, nunca hubiera podido cambiar su destino o de optimización. Pero imagina que alguien con cables en la cabeza, en realidad se introduzca en la consola de juegos Atari y cambiar físicamente de la cosa, que gana puntos en la pantalla. DQN hasta que ya no puede, ya que se encuentra en el juego y no tiene un dispositivo de puntero. Pero si la máquina va a funcionar en el mundo real, esto sería un grave problema. Así pues, si usted puede demostrar que su sistema está diseñado de tal manera que nunca será capaz de cambiar el mecanismo de enlazado a un conjunto de puntos, incluso si quiere? Es más difícil de demostrar.

En este sentido hay alguna prometedoras logros?

Hay un campo en crecimiento de los llamados киберфизических de los sistemas relacionado con los sistemas que generan los equipos en el mundo real. Con киберфизической sistema, usted consigue el paquete de bits que representan el programa de control de tránsito aéreo y, a continuación, aviones reales y se preocupan por lo que estos aviones no se enfrentan. Usted está tratando de demostrar el teorema de la combinación de bits y el mundo físico. Tienes que escribir bastante conservador de una descripción matemática del mundo físico — aviones dispersa de tal y tal manera — y sus teoremas deben permanecer verdaderos en el mundo real durante tanto tiempo hasta que el mundo real estará en este mismo sobre de comportamientos.

Usted mismo dijo que puede ser matemáticamente imposible formalmente comprobar el sistema de la ia?

Es un problema general de la "indecidibilidad" en muchos de los temas que puedes preguntar en el tema de los programas de ordenador. Alan creador ha demostrado que ningún programa de ordenador no es capaz de resolver, cuando el otro posible el programa le dará la respuesta, y cuando llegue a cargarse en un ciclo sin fin. Por lo tanto, si usted comienza con un programa, mientras que ella sí puede sobrescribir y convertirse en otro programa, tendrás problema, ya que no será capaz de demostrar que todos los posibles otros programas tendrán que cumplir con ciertos criterios. Entonces ¿por qué entonces preocuparse por el insolubilidad de los sistemas de ia, que sustituirán a sí mismo? Se invalidarán a un nuevo programa basado en el programa existente de más de la experiencia que se obtiene de la del mundo real. Cuáles serán las consecuencias de la interacción de los programas con el mundo real? Aún no lo sabemos.publicado

P. S. Y recuerde, sólo cambiando su consumo — estamos juntos cambiando el mundo! ©

Fuente: hi-news.ru

En enero de britano-americana de un científico de computación stuart russell fue el primero que firmó una carta abierta, en la que se instaba investigadores a reflexionar más profundamente acerca de su deseo de crear una inteligencia artificial superior y superior. "Recomendamos la realización de estudios avanzados para garantizar la seguridad y la sociabilidad de los sistemas de ia, cada vez con mayor potencia, — se indica en la carta. — Nuestros sistemas de ia, debemos hacer lo que queremos que hagan".

Miles de personas han firmado esta carta, incluyendo los principales investigadores de la inteligencia artificial de Google, Facebook, Microsoft y otros centros industriales, así como líderes de la computación de científicos, físicos y filósofos de todo el mundo. A finales de marzo, del orden de 300 grupos de investigación han comenzado a llevar a cabo nuevas investigaciones sobre la "conservación de la buena voluntad de la inteligencia artificial" en la herramienta de 37 firmante de la carta, el inventor-empresario elona la Máscara.

Russell, de 53 años, es profesor de ciencias de la computación y el fundador del Centro de sistemas inteligentes de la universidad de california en berkeley y hace mucho tiempo que estudia el poder y el peligro de los pensadores de la máquina. Es autor de más de 200 obras y un tutorial en este ámbito, "inteligencia Artificial: un enfoque moderno" (en colaboración con peter Норвигом). Sin embargo, un rápido progreso en el ámbito de la ia ha dado a los viejos temores a russell una importante relevancia.

En el último tiempo, dice él, la inteligencia artificial ha logrado un gran éxito, en parte gracias a los algoritmos de нейронного de aprendizaje. Se utilizan en el software de reconocimiento de caras de Facebook, personales y asistentes de ventas de smartphones y autodidactas, los coches de Google. No hace mucho, en todo el mundo прогремела red de neuronas artificial, que ha aprendido a jugar a los videojuegos de Atari mejor persona por un par de horas, tomando como base sólo los datos presentados en la pantalla, y el objetivo es marcar el máximo de puntos — no hay preprogramados de conocimientos sobre инопланетянах, cartuchos, derecho, izquierda, abajo, arriba.

"Si su bebé recién nacido lo ha hecho, podríamos pensar que está obsesionado", dice russell.

El registro de Quanta Magazine tomó el russell entrevista durante el desayuno en el encuentro Americano de física de la comunidad en marzo de 2015, en san antonio, texas, por la noche antes de que él iba a hablar sobre el futuro de la inteligencia artificial. En este tratado y ужатой versión de la entrevista russell reflexiona sobre la naturaleza de la inteligencia y sobre el rápido acercamiento a los problemas relacionados con la seguridad de las máquinas.

Usted piensa que el objetivo de su área — desarrollo de la inteligencia artificial, que "la posesión de la mente estrecha" con los valores humanos. Lo que esto significa?

Deliberadamente provocativa declaración, ya que la combinación de las dos cosas — "causa" y "valores humanos" ya de por sí es contradictorio. Bien puede ser que los valores humanos seguirán siendo un misterio para siempre. Pero de la misma manera, como estos valores se dan a conocer a nuestro comportamiento, usted puede esperar que la máquina será capaz de "tomar" la mayoría de ellos. En las esquinas se pueden quedar los trozos y piezas que la máquina no entiende o que no somos capaces de encontrar un consenso entre los mismos. Pero mientras que la máquina responda de la correcta requisitos, usted será capaz de mostrar que ella es inofensivo.

Cómo vas a lograr eso?

He aquí sobre qué tema, yo ahora trabajo: en qué punto de la máquina recibirá lo más parecidas posible a los valores a los que la gente necesita? Creo que una respuesta puede ser una técnica denominada "inversa de la educación con terminal". La enseñanza de la inmovilización es el proceso, cuando usted consigue las recompensas y los castigos, y su objetivo es llevar el proceso hasta obtener el máximo número de premios. Esto hace que el sistema de DQN (que juega en Atari); ella recibe una cuenta de juego, y su objetivo es hacer que esta cuenta anteriormente. Inversa de la educación con terminal de otra forma. Usted ve una especie de comportamiento y tratando de comprender lo que cuenta es el comportamiento de la trata de aumentar. Por ejemplo, su robot casero ve que en la mañana выползаете de la cama para echar un extraño color marrón círculo en la ruidosa máquina de hacer una intervención con el vapor y el agua caliente, la leche y el azúcar, y después mira feliz. El sistema determina que una parte importante de valor para el hombre — para obtener un café de la mañana.

En los libros, las películas y en internet hay una gran cantidad de información acerca de las acciones humanas y las relaciones, a la acción. Es increíble la base de datos para las máquinas que aprenden los valores de la gente — que recibe las medallas, que sale por la rejilla y por qué.

Cómo te iniciaste en el ámbito de la inteligencia artificial?

Cuando estaba en la escuela, en la ia no era considerado como disciplina académica en general. Pero yo estudiaba en un internado en londres, y tuve la oportunidad de acudir a la obligatoriedad de rugby, haciendo de informática de la ciencia en el vecino colegio. Uno de mis proyectos era un programa que aprende a jugar tic-tac-toe. He perdido toda la popularidad, ya que se sentó en la computadora del colegio hasta el final. En el siguiente año escribí un programa de ajedrez y ha recibido el permiso de uno de los profesores del colegio en el uso de su gigante мэйнфреймового equipo. Era increíble tratar de averiguar cómo enseñarle a jugar al ajedrez.

Sin embargo, todo esto es sólo un hobby; en ese momento mi académica era la física. Me ocupaba de la física en oxford. Y cuando luego me ha apartado de estudios de postgrado, se inclinó en el teórico de la física en oxford y cambridge y en ciencias de la computación en la universidad de massachusetts y stanford, sin darse cuenta de que perdí todos los plazos para la presentación en los estados unidos. Afortunadamente, stanford наплевал en los plazos, por lo que he pasado en él.

Durante su carrera, ha pasado mucho tiempo tratando de entender lo que es la inteligencia como condición necesaria, que pueden comprender y alcanzar la máquina. Lo que has aprendido?

Durante mi диссертационного de la investigación en la década de los 80, empecé a pensar en la gestión de la toma de decisiones y sobre el problema de la práctica de la imposibilidad de la misma. Si usted estuviera son racionales, sería pensaban: este es mi estado actual, éstos son los pasos que puedo hacer, entonces puedo hacer esto, luego esto; de qué manera se garantiza me llevará a la meta? La definición de la ordenación de la conducta exige la optimización de todo el futuro del Universo. Esto es imposible desde el punto de vista de los cálculos.

No tiene sentido tratar de encuadrar en ia imposible, por lo que empecé a pensar de otra forma: como en el casos en que tomamos decisiones?

Bueno, ¿y cómo?

Uno de los trucos es pensar en el corto plazo y, a continuación, asumir, de cómo podría lucir futuro más próximo. De ajedrez del programa, por ejemplo, si se racionales, realizando exclusivamente de los movimientos de garantizar el mate, pero ellos mismos no lo hacen. En lugar de ello, se cuentan decenas de movimientos hacia adelante y hacen suposiciones acerca de lo útil que estos próximos estado y, a continuación, toman las decisiones que conducen a uno de los mejores de estado.

El otro, que es importante no olvidar que se trata de un problema de decisiones en varios niveles de abstracción, "jerárquica de toma de decisiones". Una persona comete orden de 20 billones de acción física por su vida. Para llegar a esta conferencia y decirle que lo llevó a cometer los 1,3 millones de acciones más o menos. Si fueran racionales, que se habría tratado de calcular todos los 1,3 millones de pasos que, de hecho, es completamente imposible. La gente hace esto, gracias a la enorme equipaje abstractos de acción de alto nivel. Usted no piensa, "cuando voy a casa, voy a poner la pierna izquierda o la derecha en la alfombra, y luego podré esto y esto y esto". Usted piensa, "voy a ir a la tienda y comprar el libro. Luego de la llamada de taxis". Y todo. En general, usted no está particularmente, no necesita aclaración de piezas complejas. Como vivimos en un principio. El futuro borrosa, muchas de las piezas están cerca de nosotros en el tiempo, pero está representada principalmente por grandes piezas como "obtener el grado de", "tener hijos".

¿Los ordenadores en la actualidad son capaces jerárquica de la toma de decisiones?

Este es uno de los faltantes de piezas de rompecabezas ahora: ¿de dónde proceden todas estas acciones en un nivel alto? No creemos que programas como la red de DQN tienen abstracto de la presentación de actividades. Hay muchos juegos que DQN simplemente no entiende, y estos juegos compleja, que requiere muchos pasos computacional de antemano, en la forma de los conceptos primitivos de acción, es algo así como cuando un hombre piensa "lo que necesito para abrir la puerta?", y la apertura de la puerta incluye la extracción de la llave y así sucesivamente. Si el equipo no tiene esa forma de "abrir la puerta", ella no puede hacer nada.

Pero si esto no es un problema — y es muy posible — entonces veremos ordinario de un importante crecimiento de la capacidad de las máquinas. Hay dos o tres problemas, y si logras resolverlos, entonces me pregunto, esto es, si todavía grandes obstáculos a la ia del nivel humano.

Lo que les molesta en la posibilidad de la aparición de la ia nivel humano?

En la primera edición de mi libro (1994), existe una sección de "¿y si nos pasa?", porque me parecía que las personas no reflexionan acerca de este especial. Tal parecía demasiado lejano, несбыточным. Pero, evidentemente, la misma que el éxito se convertirá en un gran evento. "El evento más grande en la historia de la humanidad", probablemente así se puede describir. Y si es así, entonces tenemos que pensar en lo que hacemos, para perfeccionar la forma de un posible evento.

La idea básica de la explosión de la inteligencia consiste en que, una vez que la máquina ha alcanzado un determinado nivel de inteligencia, son capaces de trabajar en la ia, así como nosotros, y mejorar sus propias características — la reprogramación de sí mismo y cambiar el relleno y su inteligencia va a crecer, no por días, sino por horas. En los últimos años la comunidad poco a poco отточило sus argumentos acerca de por qué esto puede ser un problema. La forma más convincente el argumento puede consistir en la ecuación de valores: se construye el sistema, que es extraordinariamente bueno en la optimización de funciones útiles, pero es un concepto de utilidad es cuestionable. El filósofo de oxford, Nick bostrom da el ejemplo con un clip. Usted dice "haz un par de grapas", y finalmente a todo el planeta resulta ser el almacén de las grapas. Usted construye сверхоптимизатор, pero útil, que se puede premiar, bien puede llegar a ser inútil.

¿Qué pasa con las diferencias en los valores humanos?

Es un problema interno. Se puede decir, la máquina debe ir a un lado y no hacer nada en las zonas donde puede surgir un conflicto de valores. Y esto es una tarea difícil. Creo que tenemos que crear en el sistema de valores. Si usted necesita un robot casero, él debe ser capaz de orientarse bien en los valores humanos; en caso contrario, va a hacer cosas estúpidas, que coloca al gato en el horno, ya que en la nevera hay comida, y los niños tienen hambre. La vida real está llena de tales compromisos. Si la máquina va tales concesiones y ha revelado que ella es algo que no se entiende es algo que obviamente la gente, — apenas si quieres tal coche a casa.

Yo no veo ningún camino real de creación de una especie de la industria de valores. Y también creo que tiene un gran incentivo económico para su creación. Robot casero hará una de dos cosas correctamente — como el gato asado en el horno y la gente al instante de perder su credibilidad.

Surge la pregunta de si vamos a enseñar a sistemas inteligentes de comportarse correctamente, a medida que la transición a la más razonable sistemas se si significa que vamos a recibir el mejor sistema de valores, limpiado de tontos momentos, o de la máquina que aún se выкаблучиваться? Tengo hasta el momento no hay respuesta a esta pregunta.

Dijiste que debemos comprobar matemáticamente el comportamiento de la ia en todas las circunstancias posibles. Como esto va a funcionar?

Una de las dificultades a las que apuntan los hombres, en que el sistema puede arbitrariamente producir una nueva versión de sí mismo, que serán otros objetivos. Es uno de los escenarios sobre los que constantemente dicen los escritores de la ciencia ficción: ¿de qué manera la máquina se obtiene el objetivo de destruir a la raza humana. La pregunta es: ¿puede usted demostrar que su sistema nunca, no importa cuán inteligentes no se, no se copiarán originales de los objetivos establecidos trata de personas?

Sería relativamente fácil demostrar que el sistema de DQN, siendo escrita, nunca hubiera podido cambiar su destino o de optimización. Pero imagina que alguien con cables en la cabeza, en realidad se introduzca en la consola de juegos Atari y cambiar físicamente de la cosa, que gana puntos en la pantalla. DQN hasta que ya no puede, ya que se encuentra en el juego y no tiene un dispositivo de puntero. Pero si la máquina va a funcionar en el mundo real, esto sería un grave problema. Así pues, si usted puede demostrar que su sistema está diseñado de tal manera que nunca será capaz de cambiar el mecanismo de enlazado a un conjunto de puntos, incluso si quiere? Es más difícil de demostrar.

En este sentido hay alguna prometedoras logros?

Hay un campo en crecimiento de los llamados киберфизических de los sistemas relacionado con los sistemas que generan los equipos en el mundo real. Con киберфизической sistema, usted consigue el paquete de bits que representan el programa de control de tránsito aéreo y, a continuación, aviones reales y se preocupan por lo que estos aviones no se enfrentan. Usted está tratando de demostrar el teorema de la combinación de bits y el mundo físico. Tienes que escribir bastante conservador de una descripción matemática del mundo físico — aviones dispersa de tal y tal manera — y sus teoremas deben permanecer verdaderos en el mundo real durante tanto tiempo hasta que el mundo real estará en este mismo sobre de comportamientos.

Usted mismo dijo que puede ser matemáticamente imposible formalmente comprobar el sistema de la ia?

Es un problema general de la "indecidibilidad" en muchos de los temas que puedes preguntar en el tema de los programas de ordenador. Alan creador ha demostrado que ningún programa de ordenador no es capaz de resolver, cuando el otro posible el programa le dará la respuesta, y cuando llegue a cargarse en un ciclo sin fin. Por lo tanto, si usted comienza con un programa, mientras que ella sí puede sobrescribir y convertirse en otro programa, tendrás problema, ya que no será capaz de demostrar que todos los posibles otros programas tendrán que cumplir con ciertos criterios. Entonces ¿por qué entonces preocuparse por el insolubilidad de los sistemas de ia, que sustituirán a sí mismo? Se invalidarán a un nuevo programa basado en el programa existente de más de la experiencia que se obtiene de la del mundo real. Cuáles serán las consecuencias de la interacción de los programas con el mundo real? Aún no lo sabemos.publicado

P. S. Y recuerde, sólo cambiando su consumo — estamos juntos cambiando el mundo! ©

Fuente: hi-news.ru

Los científicos han creado respetuoso con el medio ambiente procesador de madera

5 trampas para la fuerza de voluntad: lo que impide el autocontrol de la