381

十个难教的机器人

(英语).

(英语).做人比创造人容易得多 举个例子,与朋友儿时打球的过程. 如果将这些活动分解为单独的生物功能,游戏将不再简单. 你需要感应器,发射机和效应器. 你需要计算出击球的难度,以便缩短你和同伴之间的距离. 你需要考虑太阳的光线,风速,以及任何可能让你分心的东西。 你需要确定球如何旋转和如何取出. 还有不相干的情况: 如果球飞起怎么办? 飞过栅栏? 炸了邻居的窗户?

这些问题显示了机器人的一些最紧迫的问题,也为我们倒计时奠定了基础. 下面列出十个最难教机器人的东西. 如果我们要履行布拉德伯里、迪克、阿西莫夫、克拉克 和其他科幻小说作家的承诺, 我们必须击败前十名。 这些小说作家看到了想象的世界, 机器在其中的行为就像人类。

铺路

(英语).

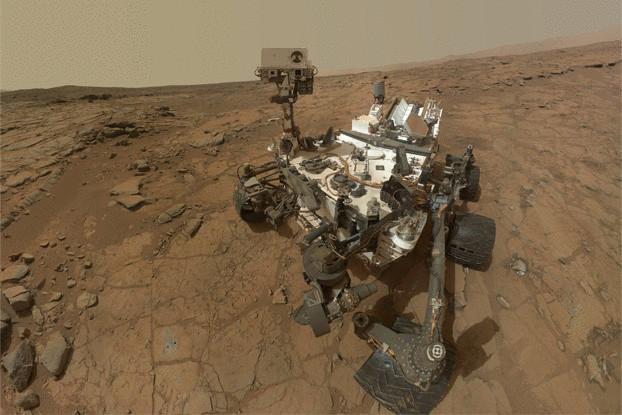

(英语).从这里移动 A点B从小就很轻松 我们人类每天都做这个,每个小时。 然而,对于机器人来说,导航——特别是通过一个不断变化的单一环境或通过它以前从未见过的环境——是一件令人生畏的事情。 首先,机器人必须能够感知环境,以及理解所有入来的数据.

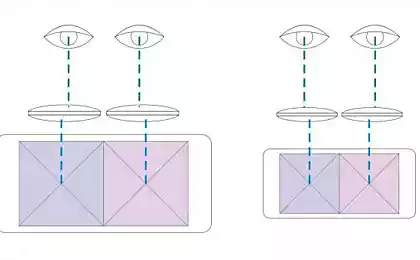

机器人用一系列传感器,扫描仪,相机等高科技工具来武装他们的机器来帮助机器人评估他们的周围环境,从而解决了第一个问题. 激光扫描仪越来越受欢迎,虽然由于光在水中被严重扭曲而不能在水生环境中被使用. 声纳技术似乎是水下机器人的可行替代品,但在地上条件下,其准确性要低得多. 此外,该机器人还利用由一套综合立体相机组成的技术视觉系统帮助“查看”其景观。

收集环境数据只是战斗的一半。 一个更困难的任务将是处理这些数据并使用这些数据作出决定。 许多开发者使用预先定义的地图来控制他们的机器人或者在苍蝇上制作. 在机器人学中,这被称为SLAM,一种同时进行导航和绘图的方法. 这里的映射是指机器人如何将传感器收到的信息转换成特定的形式. 导航涉及机器人如何相对地图进行定位. 在实际操作中,这两个过程必须同时进行,以鸡和蛋的形式进行,这只能使用强大的计算机和高级算法来根据概率来计算位置.

显示敏捷性

(英语).

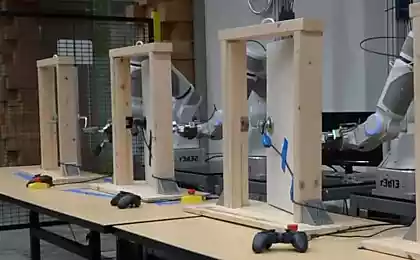

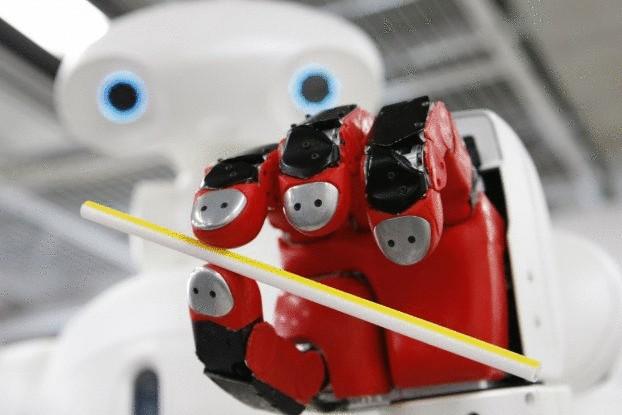

(英语).机器人多年来一直在工厂和仓库收集包装和零件. 但在这样的情况下,他们往往不与人相会,几乎总是在相对自由的环境中与类似形状的物体一起工作. 这样的机器人在工厂的生活是无聊而平凡的. 如果机器人想在家中或医院工作,就需要有先进的触觉,在选择行动方面能够探测到附近的人和无可挑剔的品味.

这些机器人技能极难教授. 通常情况下,科学家不会训练机器人去触摸,如果与另一个物体相接,就会编程失败. 然而,在过去五年左右的时间里,在将可溶解的机器人和人造皮革相结合方面取得了长足的进步. 遵守是指机器人的灵活性水平. 弹性汽车更可塑,更硬 -- 更少.

2013年,Georgia Tech的研究人员创建了带有弹簧关节的机器人臂,使操纵者可以弯曲并和人手等物体相互作用. 然后他们用皮肤涂上可以识别出压力或触碰的涂料. 某些类型的机器人外皮中含有六边形芯片,每枚都配备了红外传感器,能探测出任何比一厘米更接近的近处. 另一些则配备了电子"指印"——一个肋骨和粗糙的表面,可以改善抓取并方便信号处理.

把这些高科技操纵器和先进的视觉系统结合起来 — — 你得到一个机器人,可以进行温和的按摩,或者用文件穿过一个文件夹,从一个庞大的集合中选择正确的一个.

继续谈话

(英语).

(英语).计算机科学的奠基人之一艾伦·图灵(Alan Turing)于1950年做出了大胆的预测:有一天机器能够自由说话,以至于你无法将他们与人区分开来. 直到机器人(甚至Siri)达到图灵的期望。 因为语音识别与自然语言处理大相径庭,

最初,科学家们认为重复这段话会和将语法规则与机器记忆联系起来一样容易. 但是试图为每种语言编程语法实例失败了. 即使要确定单个单词的含义也是非常困难的(毕竟存在着同名现象——以门和小提琴为例的钥匙). 人类已经学会了在上下文中定义这些单词的含义,依靠他们在多年进化过程中所发展出的精神能力,但再次将其分解为严格的规则,可以被放入法典,事实证明是完全不可能的.

因此,今天的许多机器人都根据统计数据处理语言. 科学家们喂它们巨大的文字, 被称为"生物体", 然后让计算机把长的文字分解成块, 来了解哪些文字经常在一起, 按照什么顺序排列。 这使机器人能够根据统计分析“学习”语言。

学新东西

(英语).

(英语).假设从未打过高尔夫的人 决定学会如何挥棒 他可以读到一本关于它的书,然后尝试或观看出名的高尔夫球手练习,然后自己去尝试. 无论如何,掌握基本知识可以简单而快.

机器人在试图建立能够学习新技能的自主机器时面临着某些挑战. 一种方法,如高尔夫球,就是把活动分解成精确的步骤,然后在机器人的大脑中编程. 这表明活动的各个方面都需要分开,描述并编码,这并不总是容易做到的. 挥舞高尔夫球会的某些方面很难用文字描述. 例如手腕和肘的相互作用. 这些微妙的细节比描述要容易显示.

近年来,科学家在训练机器人模仿人类操作员方面取得了一些进展. 他们称这为"模仿训练",或"示范训练"(LfD). 他们怎么做到的? 装有宽角相机和缩放相机阵列的装备机. 这种设备使机器人能够"看到"老师执行某些活性过程. 训练算法处理此数据,以创建一个将视觉输入和所想动作相结合的数学函数图. 当然,LfD机器人需要能够忽略老师行为的某些方面 — — 比如痒痒或跑鼻子 — — 并处理机器人和人体解剖学的差异所产生的类似问题。

诡计

(英语).

(英语).奇特的欺骗艺术在动物中演化而来,以绕过竞争对手,而不被掠食者所吃. 在实践中,作为生存艺术的欺骗可以是一种非常,非常有效的自我保护机制.

另一方面,机器人可能非常困难(也许对我们有好处)。 欺骗需要想象——能够形成与感觉无关的外在物体的想法或图像——而机器通常不会. 它们很能直接处理传感器、相机和扫描仪的数据,但不能形成超越感官数据的概念。

另一方面,未来的机器人可能更擅长作弊. 格鲁吉亚 技术科学家已经能够将一些蛋白质欺骗技能转移到实验室的机器人身上. 首先,他们研究了狡猾的啮齿动物 通过引诱竞争者进入旧的和未使用的金库来保护他们的粮食储藏。 然后他们把这种行为编码成简单的规则,并把它装入他们的机器人的大脑. 机器能够使用这些算法来确定在特定情况下作弊何时可能有用. 因此,他们可以欺骗他们的同伴,把他引诱到另一个没有价值的地方。

人类的预期行动

(韩语).

(韩语).在"杰特森"(The Jetsons)中,机器人梅德·罗西(Robot Maid Rosie)得以举行谈话,做饭,打扫和帮助乔治,简,朱迪和埃尔罗伊. 为了了解Rosie的建筑质量, 乔治的老板Spaceley先生 来杰森家吃饭 饭后取出雪茄并放入口中,罗西用打火机冲向前去. 这个简单的动作代表着复杂的人类行为——根据刚刚发生的事情来预测接下来会发生什么的能力.

和欺骗一样,预测人类的行动需要机器人来想象未来的状态. 他必须能够说,“如果我看到一个人做A,那么,按照我过去的经验,他很可能做B。” 在机器人学方面,这一点是极其困难的,但人们正在取得一些进步. 康奈尔大学的一个团队开发出一个自主机器人,可以根据同伴如何与环境中的物体互动来响应. 要做到这一点,它使用一对3D相机来得到其周围的图像. 算法然后在房间里识别出关键物体,并突出其余物体. 之后,机器人利用从之前的训练中获得的大量信息,从人和所接触的物体中发展出一套具体的动作预期. 机器人对接下来的事情做出结论,并相应行事.

有时康奈尔机器人会搞错了, 但是随着相机技术的改进,

与其他机器人的坐标

(英语).

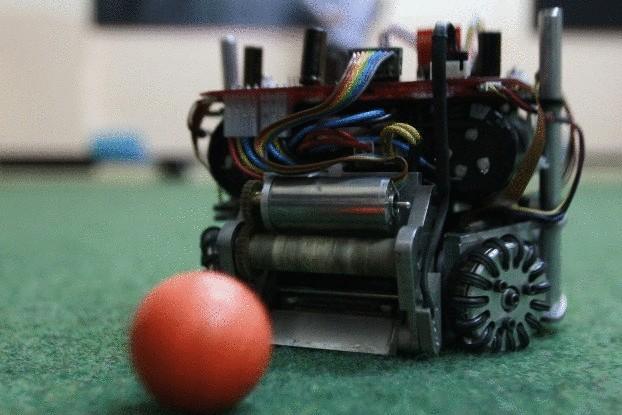

(英语).建造一台单一的大型机器——即使是机器人,如果你愿意的话——就需要认真投入时间、精力和金钱。 另一种方法涉及部署一支由较简单的机器人组成的军队,他们可以合作完成复杂的任务.

有几个问题。 在一个团队中工作的机器人必须能够很好地定位与队友的关系,并能与其他机器和人类操作员有效沟通. 为了解决这些问题,科学家们转向了昆虫的世界,昆虫利用复杂的群群行为来寻找食物并解决使整个殖民地受益的问题. 例如,通过研究蚂蚁,科学家们意识到个体使用费洛蒙来相互交流.

机器人可以使用同样的"费洛酮逻辑",只能依靠光而不是化学物质进行交流. 它的工作是这样的:一群小机器人被分散在一个被封闭的空间. 首先,他们随机探索这个区域,直到一个穿过另一个机器人留下的轻道. 他知道自己必须跟着小道走,留下自己的小道. 随着铁轨合并为一,越来越多的机器人在一头鹅中相继相继.

自复制

(英语).

(英语).主对阿丹和夏娃说:你们要富足,要繁衍,要填满大地。 接到这样的指令的机器人会感到尴尬或失望. 为什么? 因为它不能繁殖. 造出机器人是一回事,但造出一个能够复制自己或再生丢失或被损坏的部件的机器人是另一回事。

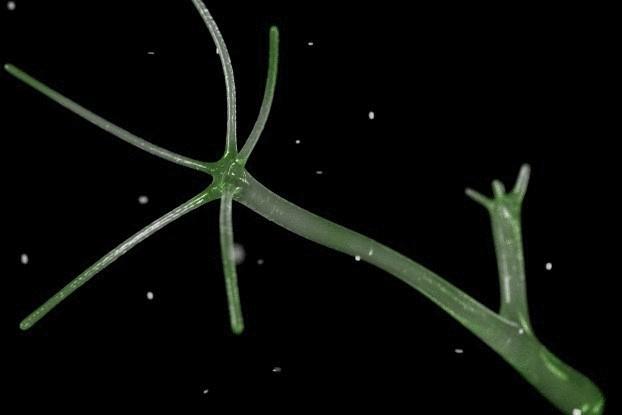

值得注意的是,机器人可能不会把人类当作生殖模型的典范. 你可能注意到我们没有被分为两个部分。 然而,最简单的人总是这样做。 水母的亲属 -- -- 水体 -- -- 练习一种称为萌芽的无性生殖形式:一个小球从父母的身体中分离出来,然后断裂而成为一个新的、遗传上相同的个人。

科学家们正在研究能够进行同样简单的克隆程序的机器人. 这些机器人多由重复元素所建,通常是立方体,由一立方体的相像和相像而成,还包含自相复制的程序. 立方体表面有磁铁,因此可以与附近其他立方体相接并分离出. 每个立方体被分出两部分对角,因此每个半相可以独立地存在. 同样的,机器人中包含数个立方体组装成某个数字.

原则行动

(英语).

(英语).当我们每天与人们交谈时,我们做出上百个决定. 在每一个方面,我们权衡我们的每一个选择,决定什么是好,什么是坏,什么是公平和不诚实的。 如果机器人想和我们一样 他们就需要理解伦理

但与语言一样,编码伦理行为是极其困难的,主要是因为没有一套单一的被接受的伦理原则. 不同国家有不同的行为准则和不同的法律制度。 即使在个别文化中,区域差异也可能影响人们如何评价和衡量自己和他人的行动。 试图写出一个适合所有机器人的全球伦理几乎是不可能的.

这就是为什么科学家决定创造机器人,限制伦理问题的范围。 例如,如果一台机器在厨房或病人房间的特定环境中运作,那么它的行为规则就会少得多,在道德上知情的决定的法律也会少得多。 为了实现这一目标,机器人工程师在机器学习算法中引入了伦理选择. 这一选择基于三个灵活的标准:行动将带来什么好处,它将造成什么伤害和衡量正义。 利用这种类型的人工智能,你未来的家用机器人将能够确切地确定家里谁应该洗碗,谁可以从电视上得到一个晚上的遥控器.

感受情绪

(英语).

(英语).“这是我的秘密,非常简单:只有心脏尖锐。 你看不到最重要的东西 “

如果福克斯在"Antoine de Saint-Exupery's The Little Prince"中的说法是正确的,那么机器人就不会看到世界上最美丽和最好的了. 毕竟,他们很擅长探索周围的世界,但他们不能把感官数据变成具体的情感. 他们看不到被爱人的笑容,感受不到欢乐,也无法平息陌生人的愤怒而恐惧地颤抖.

这比我们名单上的任何东西更能把一个人和机器分开。 你怎么教机器人坠入爱河? 你怎么安排挫折感、厌恶感、惊喜或怜悯? 我们该试试吗?

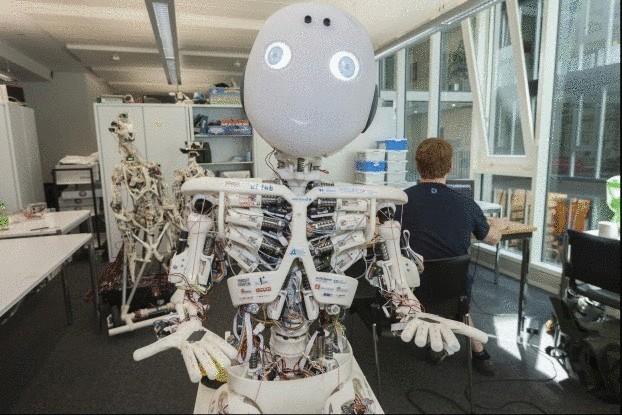

有人觉得值得 他们认为未来的机器人将结合认知和情感系统,这意味着更好的工作,更快地学习,并更有效地与人互动. 信不信由你,这种机器人的原型已经存在,它们能够表达有限的人类情感范围. 直哉由欧洲科学家所开发出的一种机器人,具有一岁婴儿的情感特质. 它可以表达出幸福,愤怒,恐惧和骄傲,用手势伴随情感. 这才刚刚开始

资料来源:hi-news.ru。