1223

如果机器人杀死人谁是有罪的?

如果你正在寻找启示的到来的迹象,这会责怪机器人,注意北方之间的非军事区和韩国。在这里,沿着世界上最坚固的边界,不仅仅是看士兵。

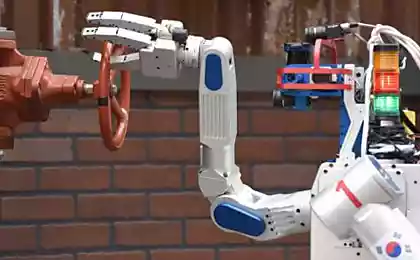

满足了SGR-A1,小时机器人,由三星在韩国的发展。 1.2米的装置看起来比一双黑色金属鞋盒多一点,但他没有灵魂的眼睛配备了红外端口,可以检测到敌人在4公里的距离。他的机枪在准备好了。

目前,机器人通知疑似攻击坐在控制室里它的创造者。并且为了他开火,需要人的批准。但是,这种机器人也正在在自动模式下,可以自行决定先拍。电阻,男同胞们,这是没用的。

五角大楼和军方世界各地正在开发越来越多的自主性武器,它远远超出了遥控无人驾驶飞机,它在华盛顿的巴基斯坦,阿富汗等国已经习惯了。技术的进步使这些新类型的武器选择的目标射击它在你的选择没有人的批准。有人预测,这些机器人总有一天会并肩作战的士兵,男性。

毫不奇怪,杀死机器人的消息,使一些人感到紧张。今年四月,设计师,研究人员和人权活动家的国际联盟召开了竞选反对建立杀手机器人,并要求外交官对联合国在日内瓦举行。竞选者要禁止的“致命武器自主”开发和利用,同时认识到这种武器,虽然技术上可行,从来没有被应用。

“这是有道理询问是否人类生命的价值,让机器人杀人的下降?” - 彼得说Asaro认为,在媒体研究的纽约学院高级讲师,以及对杀手机器人运动的代表

。

这只是一个问题的哲学家,法学家和科学家时间以来远古挣扎,而世界正在筹备新的机器人,其中,我们被告知的冲击,会修剪草坪,照顾老人,教自闭症儿童甚至我们驾驶的汽车。这些机器人可以不杀,但道路的代表希望迫使政府和法院考虑了一些法律和道德问题。我向他们要起诉,如果我被车没有司机打?如果机器人医患给出了错误的药物?如果机器人吸尘器吸不小心我的头发,而我是打瞌睡的地板上(如实际发生的对一个女人在韩国不久前)?可一个机器人犯下战争罪?

这是最后一个问题是最担心的教授Asaro介绍。他和联盟,其中包括人权观察组织声称,如果一个自治的计算机系统进行编程,以确保敌兵从平民区分开的其他成员,居然拉不触发“人批准,”这将是非常困难不断的情况控制,如果出现错误。

如果机器人出现故障,并杀死了全村,你将不能够把一个没有生命的物体,在国际刑事法院门前,或给他的军事法庭。一些专家说,你不能责怪法律,机器人甚至开发商,如果他们没有预料到机器人可以去疯狂。

在刑法中,法院必须找到所谓的犯意,或犯意(拉丁)。但他们不太可能找到什么机器人的信息 - 从人工智能的发展目前的水平 - 有意愿都没有。设计师的机器人可能会招致民事赔偿责任,如果发现机器人失控,由于程序故障。然而,他们可能不会追究杀手机器人的行为负责。

这些杀手机器人看起来像什么 - 从自主机器人无人驾驶飞机与大炮的流浪者。从2012年该指令国防部决定,自治系统“的设计应使指挥官和运营商实施相应的人力控制了使用武力的水平。”在一封电子邮件中回应来自国防环球邮报加拿大部记者提问时表示,“现在不是开发一个自主致命武器”,但他们的研究机构正在积极开展“研究计划中的无人系统»领域。

至少有一家公司从事机器人技术,滑铁卢,Ont.基的ClearPath机器人公司,表示反对的杀手机器人,尽管加拿大和美国军方建立的机器人的事实。 Gariepi瑞安的ClearPath其首席技术官的创始人之一,他说,一个良好的应用的自主军用机器人有扫雷和监测,但不是杀人的任务,特别是如果这种汽车上的战斗一面:“哪有机器人决定谁忍判死刑?是否要剥夺一个人的生命如此敌兵?»

权

不可避免地讨论凶手机器人围绕的“机器人三定律”的故事,科幻作家艾萨克·阿西莫夫的周围。第一个法律禁止害人的机器人;第二次告诉人们服从他们,只有当它不与第一定律相冲突;第三告诉机器人,以保护自己的生命 - 只要它不违反前两项法律。但多数专家认为,这些法律会做一点好,在现实世界:他们的缺点,即使阿西莫夫显示了他的故事。

不过,佐治亚理工学院,机器人的美国著名设计师,其作品对项目的罗纳德·阿尔金教授五角大楼认为杀手机器人或其他自动化武器系统可以进行编程,以遵循战争的规律 - ,并按照他们比人更好。该机器人,他说,永远不会拍的,因为恐惧,捍卫自己的生命或。他将有机会获得信息和数据,没有兵人无法处理如此迅速,使得它不太可能是错误的“战斗热”。他绝不会故意杀害平民的报复同志的逝世。它真的可以跟随战士,所以他们没有作案。

阿金教授还认为,自主技术其实已经在战场上。据他介绍,美国的爱国者导弹电池会自动选择目标,并9秒给人注册取消目标和停止导弹。美海军的密集阵系统保护船只,自动撞倒导弹。

但是,即使他们需要对更多的自主武器发展的一个暂停,只要你能证明他们可以减少平民伤亡。 “没有人愿意终结者的外观。谁希望有能的任务被送到一个系统,这将是决定谁应该被杀死? - 阿金说教授。 - 该系统的设计必须非常小心和谨慎,我认为有办法做到这一点»

。

近年来,大型科技公司越来越担心人工智能。物理学家斯蒂芬·霍金警告说,禽流感的出现“可能意味着人类的终结。”伊隆·马斯克,特斯拉汽车公司,大赦国际呼吁“生存威胁”的创始人 - 没有比核武器危险性较小。比尔·盖茨,微软的创始人,也关注。

人究竟是谁在工作中创造人工智能,说没有什么可担心的。 Yoshua Bengio,在蒙特利尔大学的研究人员领导,大赦国际指出,小说星球大战和星际迷航大大高估机器人和人工智能的能力。有一次,他说,我们可以建立一个汽车,将与人类大脑的竞争。但现在,AI也不是那么发达。

<大段引用>还有很多工作要做,之前的机器人成为这样你看到它在电影 - 石磊教授说。 - 我们仍然能够获得我们,比如说,从五年的孩子甚至成人的期望世界的了解程度很远。而要实现这一目标,可能需要十年或更长时间。我们甚至不能重复鼠标的智能化水平。

块引用>

毫无疑问,无论是硬件还是软件,机器人的发展始终推进。

由波士顿动力学,最近购买了谷歌开发的机器人,可以戴在崎岖的地形,像狗,像爬在鼠灾区。

现货命名他能击败后,站在他的脚机器狗,他的金属腿看起来诡异的现实。

但是,如果你害怕革命的杀手机器人是不可避免的,阿特拉斯,六脚的人形机器人在330磅重的,会帮助你平静下来。也是由波士顿动力创建的,他可以走楼梯,并在岩石。他看起来就像从连续剧“神秘博士”,由苹果公司开发的一个CYBERMAN。然而,它的电池的充只持续1小时。

看来,说伊恩·科尔,伦理,法律和技术部在渥太华大学的负责人,人们逐渐放弃人工智能机器的控制 - 计算机最终会做某些事情比我们好。虽然这需要一段时间才能看到的汽车,这并不需要一个驱动程序,即使现在有车的可以停。机器人IBM沃森从公司国际商业机器公司,谁赢得了白卷危害!在2011年,它是目前用于分析数以百万的医学研究建议治疗癌症患者的网页。

<大段引用>人 - 这只是一个点......在这样的事情,我有时会想,在这一点上我很喜欢亚伯拉罕在山上的时候,他听到上帝的声音,但仍然有自己决定做什么,说:教授ESSOR克尔。 - 这是很自然的医院将要医生依靠机器,因为机器有更大的潜力......然后我们到达时,人类将得到缓解的一些决定,比如开车或战争类型的点

。 块引用>

资料来源:<一href="http://geektimes.ru/company/robohunter/blog/253026/">geektimes.ru/company/robohunter/blog/253026/