520

Вчені навчилися витягти аудіосигнал з візуальної інформації

Група дослідників MIT, Microsoft та Adobe розробила алгоритм, який може реконструювати звуковий сигнал шляхом аналізу коливань об'єктів, що зображені у відео.

Зокрема, вчені в своїх експериментах змогли реконструювати звуки, відтворені сумкою чіпсів в сумці, на основі відеозапису через звуконепроникне скло від відстані 15 футів. В інших експериментах інженери відтворили звукові сигнали з алюмінієвої фольги, від поверхні води в склянці і шуму від листя будинку рослини.

Один з дослідників, Abe Davis, сказав: Коли звук потрапив до об'єкту, він викликає об'єкт, щоб перемогти. Рух цієї вібрації створює дуже тонкий візуальний сигнал, який зазвичай невидимий до голого очей. Люди не розуміли, що ця інформація була там. й

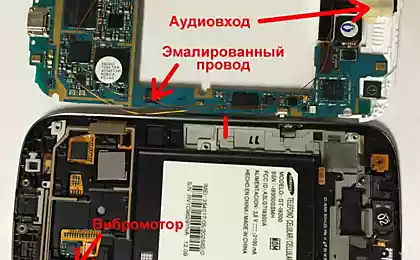

Відновлення аудіо з відео вимагає кількості відеорамок, захоплених на секунду, щоб бути вище частоти звукового сигналу. У своїх експериментах дослідники використовували швидкісну камеру, яка захопила 2000 до 6000 кадрів за секунду. Це набагато швидше 60 кадрів на секунду на деяких смартфонах, але добре нижче частота кадрів комерційних швидкісних камер, що мають 100 000 кадрів на секунду.

В інших експериментах використовуються звичайні цифрові камери. Особливий дизайн датчиків більшості камер допомогло занурювати інформацію про високочастотні коливання навіть з відео записаного стандартом 60 кадрів на секунду. Незважаючи на те, що така аудіореконструкція не була ідеальною, оскільки вона була з швидкісною камерою, вона все одно була достатньою для визначення статі динаміка в приміщенні.

Джерело: nauka24news.ru/

Зокрема, вчені в своїх експериментах змогли реконструювати звуки, відтворені сумкою чіпсів в сумці, на основі відеозапису через звуконепроникне скло від відстані 15 футів. В інших експериментах інженери відтворили звукові сигнали з алюмінієвої фольги, від поверхні води в склянці і шуму від листя будинку рослини.

Один з дослідників, Abe Davis, сказав: Коли звук потрапив до об'єкту, він викликає об'єкт, щоб перемогти. Рух цієї вібрації створює дуже тонкий візуальний сигнал, який зазвичай невидимий до голого очей. Люди не розуміли, що ця інформація була там. й

Відновлення аудіо з відео вимагає кількості відеорамок, захоплених на секунду, щоб бути вище частоти звукового сигналу. У своїх експериментах дослідники використовували швидкісну камеру, яка захопила 2000 до 6000 кадрів за секунду. Це набагато швидше 60 кадрів на секунду на деяких смартфонах, але добре нижче частота кадрів комерційних швидкісних камер, що мають 100 000 кадрів на секунду.

В інших експериментах використовуються звичайні цифрові камери. Особливий дизайн датчиків більшості камер допомогло занурювати інформацію про високочастотні коливання навіть з відео записаного стандартом 60 кадрів на секунду. Незважаючи на те, що така аудіореконструкція не була ідеальною, оскільки вона була з швидкісною камерою, вона все одно була достатньою для визначення статі динаміка в приміщенні.

Джерело: nauka24news.ru/