512

0.1

2016-09-21

Ученые научились извлекать аудио сигнал из визуальной информации

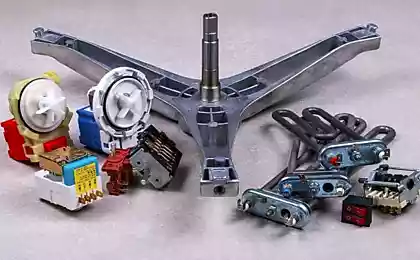

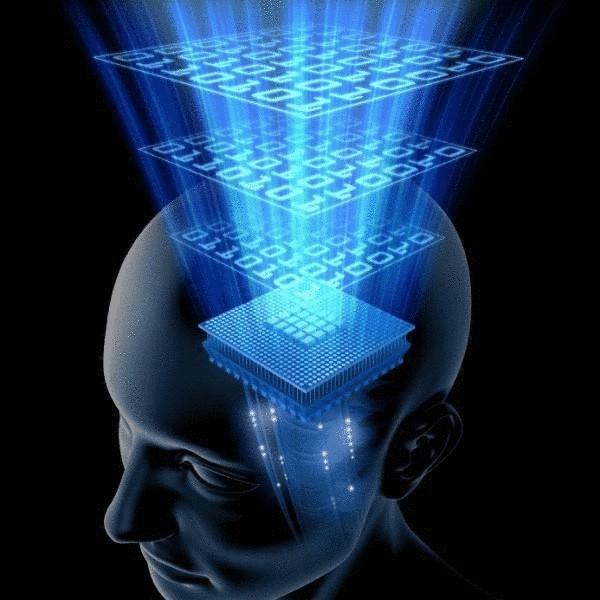

Группа исследователей Массачусетского технологического института, компаний Microsoft и Adobe разработала алгоритм, который может реконструировать аудиосигнал, путем анализа колебания объектов, изображенных на видео.

В частности, ученые в своих экспериментах смогли восстановить звуки, воспроизводимые пакетиком чипсов в сумке, на основе видеозаписи через звуконепроницаемое стекло с расстояния 15 футов. В других опытах, инженеры воссоздали звуковые сигналы от алюминиевой фольги, с поверхности воды в стакане и шум от листьев комнатного растения.

Один из исследователей, Эйб Дэвис рассказал: «Когда звук попадает на объект, он заставляет объект вибрировать. Движение этой вибрации создает очень тонкий визуальный сигнал, который, как правило, невидно невооруженным глазом. Люди даже не понимают, что эта информация была там».

Восстановление аудио из видео требует, чтобы число кадров видео, захваченных в секунду, было выше, чем частота звукового сигнала. В своих экспериментах исследователи использовали высокоскоростную камеру, которая захватывала от 2000 до 6000 кадров в секунду. Это гораздо быстрее, чем 60 кадров в секунду с некоторых смартфонов, но значительно ниже частоты кадров коммерческих высокоскоростных камер, имеющих 100000 кадров в секунду.

В других экспериментах они использовали обычную цифровую камеру. Особая конструкция датчиков большинства камер помогла вывести информацию о высокочастотных колебаниях даже из видео, записанного со стандартными 60 кадрами в секунду. Хотя такая аудиореконструкция не была идеальной, как это было с высокоскоростной камерой, она все же была достаточно хороша для определения пола говорящего в комнате.

Источник: nauka24news.ru/

В частности, ученые в своих экспериментах смогли восстановить звуки, воспроизводимые пакетиком чипсов в сумке, на основе видеозаписи через звуконепроницаемое стекло с расстояния 15 футов. В других опытах, инженеры воссоздали звуковые сигналы от алюминиевой фольги, с поверхности воды в стакане и шум от листьев комнатного растения.

Один из исследователей, Эйб Дэвис рассказал: «Когда звук попадает на объект, он заставляет объект вибрировать. Движение этой вибрации создает очень тонкий визуальный сигнал, который, как правило, невидно невооруженным глазом. Люди даже не понимают, что эта информация была там».

Восстановление аудио из видео требует, чтобы число кадров видео, захваченных в секунду, было выше, чем частота звукового сигнала. В своих экспериментах исследователи использовали высокоскоростную камеру, которая захватывала от 2000 до 6000 кадров в секунду. Это гораздо быстрее, чем 60 кадров в секунду с некоторых смартфонов, но значительно ниже частоты кадров коммерческих высокоскоростных камер, имеющих 100000 кадров в секунду.

В других экспериментах они использовали обычную цифровую камеру. Особая конструкция датчиков большинства камер помогла вывести информацию о высокочастотных колебаниях даже из видео, записанного со стандартными 60 кадрами в секунду. Хотя такая аудиореконструкция не была идеальной, как это было с высокоскоростной камерой, она все же была достаточно хороша для определения пола говорящего в комнате.

Источник: nauka24news.ru/

Портал БАШНЯ. Копирование, Перепечатка возможна при указании активной ссылки на данную страницу.

В Англии рождаются дети с наркотической зависимостью

Лучшие фильмы о художниках, которые вы возможно пропустили