710

如何表现为一个无人驾驶车辆的情况下,以避免在意外伤亡不能?

从图卢兹经济学院,由让 - 弗朗索瓦·Bonnfonom(让 - 弗朗索瓦·Bonnefon)为首的法国科学家发表的一篇科学论文“Robomobilyam需要实验伦理:是我们准备的道路上生产的汽车»(的Autonomous车辆需要实验伦理:我们准备好了功利汽车),它试图回答这个棘手的伦理问题:究竟应该无人驾驶车辆的情况下的行为是无法避免事故的发生,受害者是不可避免的?笔者调查了数百人参与众包网站亚马逊的Mechanical Turk ,它汇集的人谁愿意做任何工作的问题,其中计算机它不能够,由于种种原因。在文章<一个href="http://www.technologyreview.com/view/542626/why-self-driving-cars-must-be-programmed-to-kill/">обратил注意资源MIT技术评论。

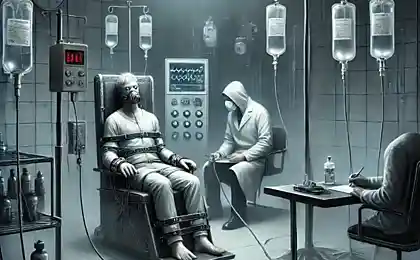

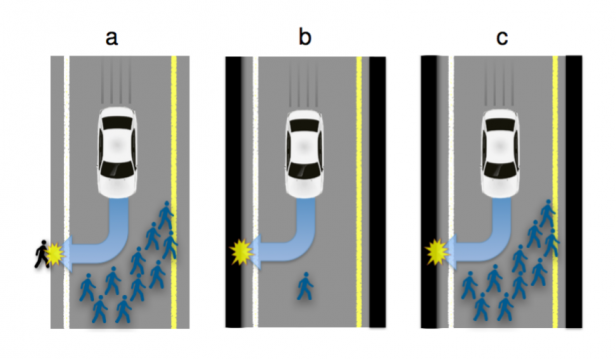

该研究的作者来比较细,而无需人明确的答案:是或否。因此,在robomobilem我们的意思是真正自主的汽车是完全由电脑控制的,没有对现场情况的人的影响的可能性。它制定了几个问题,示出多种情况,其中计算机算法控制robomobilem的行为变得一个伦理问题。例如,如果交通情况是这样的,只有两种选择:避免与一组10步行者碰撞意味着进入或撞击停在一大群人,受害者的数量确实是不可预知的。那么,如何应到计算机算法?更困难的局面:如果道路只有一个行人和一个robomobil?什么是伦理上更容易接受? - 杀行人或杀死车主

该研究显示,人们认为“相对可以接受的”,如果robomobil进行编程,以最大限度地减少道路交通事故的情况下的人员伤亡。换句话说,如果涉及行人10可能发生的意外,计算机算法来实际牺牲自己。然而,或多或少明确的答案调查收到确切的时刻,当研究对象不落轮robomobilya背后 - 把自己在他们拒绝了司机的位置。这导致的矛盾另一个问题。越少的人会买robomobili,这实在是比住司机进入危险的情况下小很多,更多的人会死在传统汽车事故。换句话说,这是不可能的买方未来guglomobilya享受积分许可协议,这将说明,在一个不可避免的事故受害者,结果的情况下,该软件实际上是选择要杀死它的主人之一。

资料来源: geektimes.ru/post/264794/