941

Elon Musk está financiando a los grupos de investigación involucrados en la cuestión - si la inteligencia artificial es seguro

Cartel promocional de la película "Terminator: Génesis» i> sup>

La semana pasada, una organización & quot privada sin fines de lucro; Futuro del Instituto Vida & quot; (FLI), con sede en Boston (EE.UU.), объявила que recibieron una ronda importante de financiación de $ 10 millones. La mayor parte de las donaciones a la $ 7.000.000 hecho Elon Musk, el resto del dinero ha sido transferido a otra organización sin fines de lucro href="http://www.openphilanthropy.org/"> Abrir Filantropía Proyecto. La ocupación principal de FLI es encontrar grupos de investigación especializados que trabajan en el campo de la inteligencia artificial, y su financiación. Uno de los objetivos establecidos antes que los científicos reciben subvenciones del FLI, es el desarrollo de un seguro para la humanidad "la inteligencia computacional", que no conducen a en el futuro a una catástrofe global.

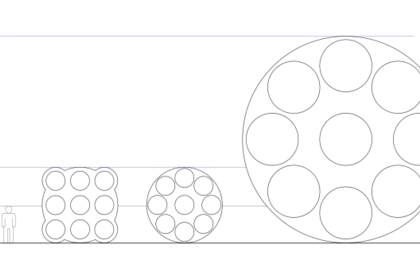

En millones de dólares desde el jefe de SpaceX y grupos Abrir Filantropía Proyecto compartirán los 37 grupos de investigación que trabajan en las universidades conocidas y bien establecidas. BusinessInsider перечисляет Algunos de estos proyectos de investigación. Por ejemplo, el grupo unido de algoritmos Creación ocupados científicos de Berkeley y Okforda que se entrenan las preferencias humanas que en el futuro podría ayudar AI comportarse "como un hombre." El personal de la Universidad de Duke (Carolina del Norte, EE.UU.) se han fijado un objetivo más ambicioso: quieren desarrollar un sistema de inteligencia artificial que podría decidir teniendo en cuenta la "moralidad humana". La Universidad de Denver en realidad está trabajando en maneras de contrarrestar la "Skynet", para hacer frente a una posible pérdida de control de los brazos robóticos.

A finales de noviembre del año pasado, Elon Musk marcó en un debate público en Internet sobre la seguridad de la inteligencia artificial. Según el jefe de SpaceX, que no se fía de la posibilidad de ordenadores para pensar y predice la aparición de "algo muy peligroso en el rango de 5 a 10 años", es decir por este peligro simplemente AI. Por alguna razón desconocida comentario máscara desaparecido unos minutos después de la publicación, pero otros Edge.org consiguió desviar como una captura de pantalla. Un portavoz de la máscara prometido en el futuro para presentar la opinión oficial de su jefe sobre el asunto, pero que, al parecer, aún no ha sucedido.

Cabe señalar que la máscara es en realidad el punto de vista del famoso científico británico Stephen Hawking, que incluso antes dijo lo siguiente: "Todos estos logros [ en el desarrollo de la inteligencia artificial] palidece en el contexto de lo que nos espera en las próximas décadas. La creación y el éxito de la inteligencia artificial será el evento más grande en la historia de la humanidad. Por desgracia, puede ser la última, a menos que aprendamos a evitar riesgos ". Hawking cree que el estudio de la seguridad de la IA dedicó demasiado pequeñas obras científicas serias y hay muy pocos centros de investigación que podrían hacerlo. Curiosamente, entre las organizaciones mencionadas Hawking y FLI. ¿Hay alguna conexión entre Stephen Hawking y Elon Musk no se conoce.

Hay un punto de vista de los científicos alternativa, aunque no con un nombre tan grande como el profesor Hawking. Ellos creen que el tema de la liberación de la inteligencia artificial fuera de control - es más un tema de películas de ciencia ficción que de grave preocupación. Leer sus contraargumentos pueden aquí .

Fuente: geektimes.ru/post/253088/

Robomobili Google dos veces involucrado en un accidente en junio (causado por el hombre)

7 PROHIBICIONES FENG SHUI