1993

розпізнавання краси обличчя

"Мій світлий, дзеркальний, скажеш його."

Покажіть мені правду.

Я найсолодша людина в світі,

Все червоний і білий

А.С. Пушкін

Чарівні речі з казок поступово реалізуються в реальному світі через використання нових технологій та наукових відкриттів. В даний час такі пристрої, як ковролін (авіація), прискорювачі (автомобільи), яблуко на платі (мережа з Інтернетом), гломерулу, яка показує дорогу (GPS-навігатор) та інші необхідні речі реалізуються та активно використовуються. Ми спробували впровадити систему оцінки краси обличчя людини, зазначеної в «загальній формі мертвих князів та сім героїв» за допомогою штучного інтелекту та машинного бачення методів (надалі автор означав планшет з передньою камерою та користувальницькою справою).

Питання про те, що саме робить обличчя людини привабливими, є тема дослідження фізіологами, біологами, філософами, істориками мистецтва, спеціалістами пластичної хірургії тривалий час. В даний час вважається, що люди, крім індивідуальних переваг, впливають на загальні біологічно-мотивовані принципи оцінки краси [1-2]. Серед можливих кандидатів на типові ознаки фізіологи виділяють симетрію рис обличчя [3], різницю в образі обличчя від середнього образу обличчя великої кількості осіб [4], листування пропорцій обличчя до «золотого розділу» [5] та ін. Наприклад, [4] показує, що, з одного боку, симетричні риси обличчя відповідають меншим мутованим генам і тому люди з такими особливостями обличчя більш стійкі до мутацій і захворювань, а з іншого боку, люди з більш симетричними рисами обличчя отримують більш високі показники краси при оцінюванні експертів.

В останні роки на комп’ютерних системах розпізнавання краси з’явилася кілька першоджерелів, які на основі використання систем машинного бачення [6-8] та тренувальних класифікаторів. Ці роботи можна побачити як спроба допускати роботизовані системи з можливістю «дивитись красивим». У [6] пропорції функцій обличчя використовуються як функції, з ключовими точками на обличчі виділяється вручну. У [7], крім пропорцій, метод основного компонента використовувався для ізоляції особливостей. У [8] використовуються глибокі нейронні мережі для розпізнавання краси.

Ми розробили автоматичну систему оцінки краси на основі методу визначення ключових точок на обличчі за допомогою бібліотеки машинного бачення OpenCV та нейромережі, що навчаються в задачі експертної оцінки та проведено експериментальну оцінку якості його роботи.

База даних зображень для навчання

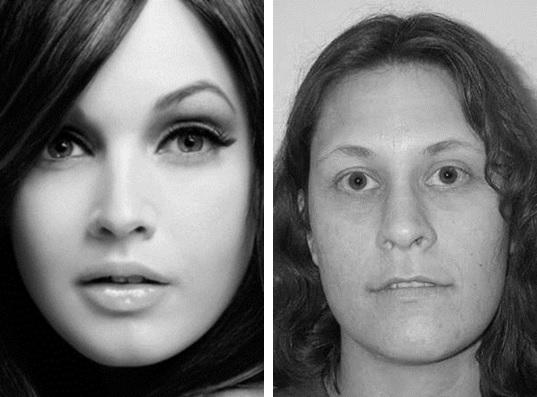

Ми зібрали власні бази даних зображень, що складаються з 180 фото обличчям молодих жінок, зображень були взяті з відкритих джерел. Вибрано фото обличчя у передній проекції з нейтральним виразом обличчя, без окулярів та ювелірних виробів. Щоб зробити представник зразка, ми спробували включати приклади як красивих, так і неглибоких обличчя в базі даних (рис. 1).

Рис. 1. Приклад фотографій обличчя з бази даних зображень

На відміну від роботи [7] зібрана база включає фотографії жінок різних рас, колір шкіри та вікові діапазони від 18 до 35 років. Після зібрання зображень група експертів попросила встановити суб’єктивний естетичний рейтинг оскаржень для кожного з фотографій на масштабі 1 до 7. В цілому, 8 експертів, 4 чоловіків і 4 жінок віком від 16 до 63 років були залучені до маркування фотографій, оцінки експонувалися самостійно. За умовами експерименту, перед початком процесу оцінювання, кожен експерт був представлений з усіма фотографіями для початкового огляду. Для перевірки консистенції зразка проведено кореляційний аналіз, його результати представлені в вкладці. 1,1 км

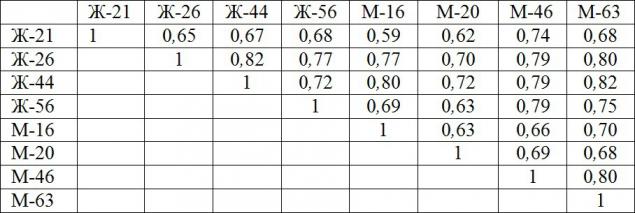

Настільний 1. Поранчеві кореляції оцінок різних експертів

Середня кореляція зразка була на рівні 0,7, що дає можливість навчати нейромережу на таких даних і приблизно відповідає результатам інших дослідників [4,7].

Загальна схема алгоритму

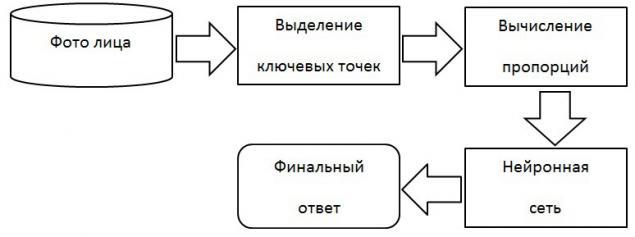

Система розпізнавання краси отримує зображення, що містить передню фото обличчя людини (рис. 2).

Рис. 2. Схема алгоритму розпізнавання краси обличчя

Перед алгоритмом роботи ми припустимо, що особа в образі вже висвітлена і займає більшу частину площі зображення. Потім, використовуючи стандартний підсилювач класу Viola-Jones, який є частиною бібліотеки машинного бачення OpenCV, зони на обличчі, відповідних правим і лівим поглядам, ніс і рот відрізняється.

Виходячи з цих координат розраховується основні пропорції особи, які потім використовуються в якості функції вектора для нейромережі. Нейромережа вперше навчається на цьому введенні з використанням експертних оцінок як цільового зразка, а потім може використовуватися для розпізнавання нових, попередньо невидимих даних.

Ідентифікація знаків

Ми можемо самі зателефонувати одержувачу і узгодити зручний час і місце вручення квітів, а якщо необхідно, то збережемо сюрприз.

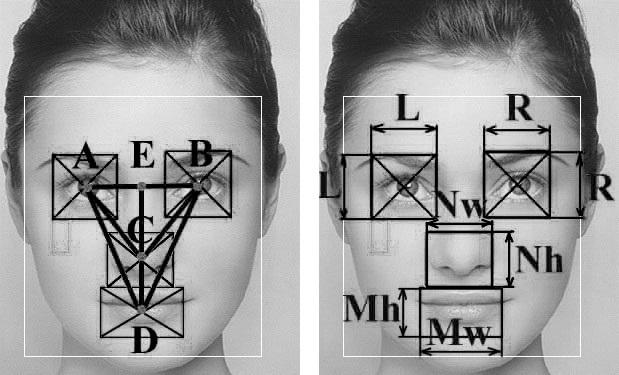

Особлива група 1 показано на малюнку 3, зліва: AB/CD, AC/BC, AD/BD, EC/ED, EC/AB, AC/AD, BC/BD. Особлива група 2 представлена на малюнку 3, право: L/R, Mw/Mh, Nw/Nh, Mw/Nw, Mh/Nh. Вектор кінцевої функції складається з комбінованих особливостей обох груп. До годування нейромережі дані було зменшено до діапазону [1;1].

Рис. 3. Розрахунок особливостей векторів за вибраними ключовими точками на обличчі

Навчання нейромереж

Ми використовуємо стандартний багатошаровий перцептрон [10, сторінка 219] з одним прихованим шаром, що містить 5 нейронів у прихованому шарі. Функція гіперболічного тангента використовується як функції активації нейронів прихованого та вихідного шару. Нейромережа була навчена розширеним методом фільтра Калмана [10, сторінка 219], [11], що на сьогоднішній день є одним з найбільш ефективних методів навчання другого порядку для нейромереж. Перед тренуванням зразок поділився на 2 частини: навчання (110 прикладів, 60% зразка) і огляд (70 прикладів, 40% зразка). У таблиці представлені результати тренінгу. 2,2 км

Таблиця 2. Результати навчання нейромереж на задачі визнання краси

207552

Ми вважаємо, що отриманий кореляційний результат 0.5 на невикористаний зразок іспиту дуже добре для невеликої кількості інформації, що надавалася нейромережі, як ознаки. Насправді нейромережа приймає рішення на основі аналізу структури кісток черепа, ігнорування інших даних, які людина враховує при вирішенні подібної проблеми.

У майбутньому ми плануємо поліпшити алгоритм, розширивши базу даних зображень для навчання, висвітлюючи нові ключові точки на обличчі і в тому числі детектор гладкості шкіри.

Оригінальна стаття: Чернодуб А.Н., Пащенко Ю.А., Головаченко К.А. Неурална мережа для визначення привабливості обличчя людини // XV Всеросійська науково-технічна конференція «Невроінформатика-2013», Москва, 21-25 січня 2013 р., с. 254 - 259.

Список посилань

- Ковач, Ф. J. Філософія краси//норман: Університет Оклахома Прес. 1974.

- Граммер К, Торніл Р. Людина (Homo sapiens) привабливість обличчя та сексуальний вибір: роль симетрії та середньої ваги. // J Comp Психол, 1994, В. 108, No 3. С. 233-242.

- Родос, Г. Еволюційна психологія краси обличчя, Анну. Психол. 2006. В. 57. П. 199-226.

- Sheib J.E., Gangestad S.W., Thornhill R. Охорона обличчя, симетрія і кулі хороших генів // Proc Biol Sci. 1999 Вересень 22; 266(1431). 1913-1917.

- Голландія Е. Марквардт Phi Маска: Питпади спираючись на Модні моделі та Золотий Рітіо, щоб описати гарне обличчя // естетична пластична хірургія, 2008, В. 32, No 2. С. 200-208.

- Аарабі, П., Hughes, Д., Могайер, К., Emami, М. Автоматичне вимірювання краси обличчя // IEEE International Conference on Systems, Людина та Cybernetics, 710 Жовтень 2001, Тюсон, США. П. 2644-2647.

- Eisenthal Y., Dror G., Ruppin E. Обличчя Привабливість: Краса і машина // Неуралне обчислення, 2006, В. 18, No 1. С. 119-142.

- Ган Дж., Лі Л., Згай Ю. Глибоке самостійне навчання для прогнозування краси обличчя. DOI: 10.1016/j.neucom. 2014.05.028

- Сірий Д., Ю К., Су В., Гонг Ю. Вирок обличчя Краса без знаків // Комп'ютерне бачення – ECCV 2010, Лекторні ноти в комп'ютерних наук, 2010, В. 6316/2010. С. 434-447.

- Хайкін С. Неуральні мережі: повний курс. Вільямс, 2006.

- Чернодуб А.Н. Навчання Неуралних мереж для класифікації за допомогою розширеного Kalman Filter: порівняльне дослідження, 2014. С. 96-103.

Джерело: habrahabr.ru/post/229549/

Швейцарська армія: як це було зроблено

Літопис про космічні ваги. Зареєструватися 3. Нью-ера Марстодонс