276

5个不害怕人工智能的理由

第436444号

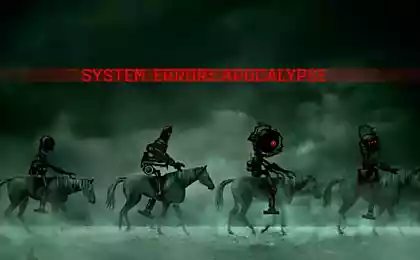

随着人工智能领域的最新消息,显然有一种日益增长的兴奋: 如果我们处于世界末日的边缘呢? “终结者”或“矩阵”等电影曾给我们带来许多恐惧 — — 而今天,很多人认为计算机发展超人智能和毁灭人类的情景是可能的。

在这些人中,有著名的未来学家——Ray Kurzweil,Robin Hanson和Nick Bostrom. 未来主义者大多认为,我们高估了计算机会像智能生物一样思考的可能性,以及这种机器对人类构成的危险. 智能机器的发展很可能是一个缓慢而渐进的过程,拥有超人智能的计算机,如果存在的话,会像我们所需要的那样给予我们同样多. 曰为甚么.

1. 联合国 真正的智能需要实践的经验.

Bostrom,Kurzweil等超人智能理论家无休止地相信可以解决任何智力问题的野蛮计算力量的力量. 然而,在许多情况下,真正的问题并不是缺乏智能马力.

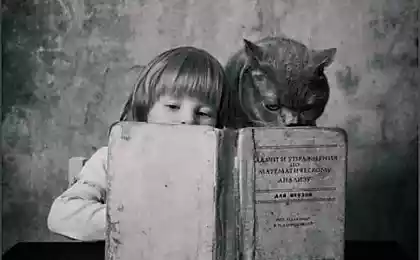

为了理解原因,想象一下一个会讲俄语但从未讲过中文的人。 将他锁入一屋子,里面有一大堆中国书籍,并让他学习. 无论一个人多么聪明,学习中文的时间有多长,他们永远也学不到一个自称是本地汉语使用者的地道.

这是因为学习一种语言的一个组成部分是与其他母语人互动。 在与他们的对话中,你可以学习本地口语,检测出语言含义中微妙的影子并学习通俗的谈话话题. 原则上,所有这些东西都可以被写入教科书中,但实际上并非如此——因为语言的细微差别因地而异并取决于时间.

一个试图发展人类层面智能的机器将面临更严重的同类问题. 一个计算机程序永远不会在人类家庭里成长,坠入爱河,被冻结,饥饿或疲惫. 简言之,它不会有那么多允许人们自然地相互交流的背景。

这一观点适用于智能机器能够面对的大多数其他问题,从钻取油井到解决税收问题. 解决困难问题所需的大部分信息没有在任何地方被写出,因此,仅靠理论推理并不能帮助找到正确的答案. 成为专家的唯一方法就是做点什么,看看结果.

这一过程极难自动化。 这就像做实验,看看实验的结果——一个在规模,时间和资源上非常昂贵的过程. 根据这种设想,计算机迅速超过掌握知识和能力的人是不可能的——智能计算机将和人类一样使用"泵法".

2. 联合国 机器极其依赖人

在"终结者"系列中,天网变得自觉并开始使用军事装备来毁灭人.

这种情景严重低估了机器对人类的依赖. 现代经济以发挥各种专门功能的数百万台不同机器为基础. 虽然越来越多的这些机器正在向自动化移动,但在某种程度上,它们都依赖于为它们提供能量和原材料,修理它们,生产更多的替换机器等的人.

你可以想象人类建造大量这些机器人以满足需求. 但是,我们没有哪一个地方可以建造通用机器人。

由于无休止的倒退问题,创造这种机器人根本不可能:能够建造、修理和维护世界上所有机器的机器人将极其复杂。 需要更多的机器人来维护它们. 进化通过从细胞入手来解决了这个问题,细胞是一个相对简单且能自复制的所有生命的构件. 今天的机器人没有类似的东西(尽管有些未来主义者有梦想),

这意味着除非机器人或纳米技术有重大突破,否则机器将依赖于人类的支持,维修和其他服务. 一个决定毁灭人类的智能电脑会自杀.

3个 人脑极难模仿.

博斯特罗姆认为,如果没有其他选择,科学家将能够通过模仿人类大脑来产生至少人类层面的智能. 但比乍一看看起来困难得多。

数字计算机是模仿其他数字计算机的行为的方法,因为计算机以精确定义,决定性的方式运作. 为了模拟计算机,你只需要执行计算机遵循的一系列指令.

人脑相去甚多. Neurons是复杂的模拟系统,其行为不能像数字芯片的行为那样被建模. 而即使是模仿某些中子的微微不准确,也会导致整个大脑被最高程度地干扰.

一个很好的类比就是模拟天气。 物理学家对单个空气分子的行为有了很好的了解. 你可能认为可以建立一个地球大气层模型,预测遥远的未来的天气。 但直到现在,天气模拟仍然是一个在计算上难以解决的问题。 模拟早期的小出错在后期发展为一出由大出错组成的雪球. 尽管过去几十年计算力的大幅提升,但我们只能起草一个微小的程序来预测未来的天气规律.

模拟大脑产生心灵可能比模仿天气行为更具挑战性. 没有理由相信科学家能在可预见的将来做到这一点.

4.四. 对权力来说,关系可能比智力更重要

Bostrom建议智能机器可以变得"极其强大,可以根据其偏好来塑造未来". 但是,如果我们想到人类社会是如何运作的,那么很明显,光靠智慧不足以获得这种力量.

如果是这样的话,社会将受到科学家,哲学家,国际象棋天才的统治. 尽管如此,社会仍由弗拉基米尔·普京,巴拉克·奥巴马,马丁·路德·金,斯大林,里根,希特勒等人物所统治. 这些人获得了力量和力量,不是因为他们非常聪明,而是因为他们有良好的魅力,联系,并且知道如何把胡萝卜和棍子结合起来,让别人做他们的意志.

是的,杰出的科学家在创造像原子弹这样的强大技术方面发挥了作用。 显然,智能计算机也能做到这一点。 但是,建设新技术并将其付诸实践需要政府和大公司能够负担的一堆金钱和劳动力。 研制出原子弹的科学家需要富兰克林·罗斯福来资助他们的工作.

思考电脑也是如此。 任何接管世界的全面计划都需要数千人的合作。 没有理由相信计算机比科学家效率更高. 恰恰相反,鉴于友情、组合和魅力是多少,一个没有朋友的不健全的计算机程序将处于极大的劣势。

雷·克兹韦尔(Ray Kurzweil)认为, 计算机总有一天会变得如此聪明, 最有力量的想法不是只有发明者能理解的想法. 最强大的思想是那些被许多人广泛接受和理解,使其对世界的影响倍增的思想. 它既有利于人类思想,也有利于机器思想. 为了改变世界,超级智能计算机需要给公众带来变化.

5 (韩语). 智取越多,价值就越低

人们会期望计算机利用他们的优越智慧变得惊人地富有,然后利用其巨大的财富来贿赂人们. 但是它忽略了一个重要的经济原则:随着资源变得越来越普遍,其价值会下降.

60年前,一台可能低于现代智能手机的计算机价值数百万. 现代计算机可能比前几代计算机强大得多,但计算功率的价值下降快于其能力提高.

因此,第一台超级智能计算机可能会赚到很多钱,但是它的优势会一去不复返. 随着计算机芯片在计算能力上的价值和收益持续下降,人们会建造出更多的超级智能计算机. 他们的独特能力将变得平庸.

在一个知识丰富的世界中,最宝贵的资源将是有限的资源——土地、能源、矿物。 因为这些资源被人类控制, 我们至少会拥有同样多的 智能计算机的影响力。

资料来源:hi-news.ru。

资料来源:/用户/1617。

随着人工智能领域的最新消息,显然有一种日益增长的兴奋: 如果我们处于世界末日的边缘呢? “终结者”或“矩阵”等电影曾给我们带来许多恐惧 — — 而今天,很多人认为计算机发展超人智能和毁灭人类的情景是可能的。

在这些人中,有著名的未来学家——Ray Kurzweil,Robin Hanson和Nick Bostrom. 未来主义者大多认为,我们高估了计算机会像智能生物一样思考的可能性,以及这种机器对人类构成的危险. 智能机器的发展很可能是一个缓慢而渐进的过程,拥有超人智能的计算机,如果存在的话,会像我们所需要的那样给予我们同样多. 曰为甚么.

1. 联合国 真正的智能需要实践的经验.

Bostrom,Kurzweil等超人智能理论家无休止地相信可以解决任何智力问题的野蛮计算力量的力量. 然而,在许多情况下,真正的问题并不是缺乏智能马力.

为了理解原因,想象一下一个会讲俄语但从未讲过中文的人。 将他锁入一屋子,里面有一大堆中国书籍,并让他学习. 无论一个人多么聪明,学习中文的时间有多长,他们永远也学不到一个自称是本地汉语使用者的地道.

这是因为学习一种语言的一个组成部分是与其他母语人互动。 在与他们的对话中,你可以学习本地口语,检测出语言含义中微妙的影子并学习通俗的谈话话题. 原则上,所有这些东西都可以被写入教科书中,但实际上并非如此——因为语言的细微差别因地而异并取决于时间.

一个试图发展人类层面智能的机器将面临更严重的同类问题. 一个计算机程序永远不会在人类家庭里成长,坠入爱河,被冻结,饥饿或疲惫. 简言之,它不会有那么多允许人们自然地相互交流的背景。

这一观点适用于智能机器能够面对的大多数其他问题,从钻取油井到解决税收问题. 解决困难问题所需的大部分信息没有在任何地方被写出,因此,仅靠理论推理并不能帮助找到正确的答案. 成为专家的唯一方法就是做点什么,看看结果.

这一过程极难自动化。 这就像做实验,看看实验的结果——一个在规模,时间和资源上非常昂贵的过程. 根据这种设想,计算机迅速超过掌握知识和能力的人是不可能的——智能计算机将和人类一样使用"泵法".

2. 联合国 机器极其依赖人

在"终结者"系列中,天网变得自觉并开始使用军事装备来毁灭人.

这种情景严重低估了机器对人类的依赖. 现代经济以发挥各种专门功能的数百万台不同机器为基础. 虽然越来越多的这些机器正在向自动化移动,但在某种程度上,它们都依赖于为它们提供能量和原材料,修理它们,生产更多的替换机器等的人.

你可以想象人类建造大量这些机器人以满足需求. 但是,我们没有哪一个地方可以建造通用机器人。

由于无休止的倒退问题,创造这种机器人根本不可能:能够建造、修理和维护世界上所有机器的机器人将极其复杂。 需要更多的机器人来维护它们. 进化通过从细胞入手来解决了这个问题,细胞是一个相对简单且能自复制的所有生命的构件. 今天的机器人没有类似的东西(尽管有些未来主义者有梦想),

这意味着除非机器人或纳米技术有重大突破,否则机器将依赖于人类的支持,维修和其他服务. 一个决定毁灭人类的智能电脑会自杀.

3个 人脑极难模仿.

博斯特罗姆认为,如果没有其他选择,科学家将能够通过模仿人类大脑来产生至少人类层面的智能. 但比乍一看看起来困难得多。

数字计算机是模仿其他数字计算机的行为的方法,因为计算机以精确定义,决定性的方式运作. 为了模拟计算机,你只需要执行计算机遵循的一系列指令.

人脑相去甚多. Neurons是复杂的模拟系统,其行为不能像数字芯片的行为那样被建模. 而即使是模仿某些中子的微微不准确,也会导致整个大脑被最高程度地干扰.

一个很好的类比就是模拟天气。 物理学家对单个空气分子的行为有了很好的了解. 你可能认为可以建立一个地球大气层模型,预测遥远的未来的天气。 但直到现在,天气模拟仍然是一个在计算上难以解决的问题。 模拟早期的小出错在后期发展为一出由大出错组成的雪球. 尽管过去几十年计算力的大幅提升,但我们只能起草一个微小的程序来预测未来的天气规律.

模拟大脑产生心灵可能比模仿天气行为更具挑战性. 没有理由相信科学家能在可预见的将来做到这一点.

4.四. 对权力来说,关系可能比智力更重要

Bostrom建议智能机器可以变得"极其强大,可以根据其偏好来塑造未来". 但是,如果我们想到人类社会是如何运作的,那么很明显,光靠智慧不足以获得这种力量.

如果是这样的话,社会将受到科学家,哲学家,国际象棋天才的统治. 尽管如此,社会仍由弗拉基米尔·普京,巴拉克·奥巴马,马丁·路德·金,斯大林,里根,希特勒等人物所统治. 这些人获得了力量和力量,不是因为他们非常聪明,而是因为他们有良好的魅力,联系,并且知道如何把胡萝卜和棍子结合起来,让别人做他们的意志.

是的,杰出的科学家在创造像原子弹这样的强大技术方面发挥了作用。 显然,智能计算机也能做到这一点。 但是,建设新技术并将其付诸实践需要政府和大公司能够负担的一堆金钱和劳动力。 研制出原子弹的科学家需要富兰克林·罗斯福来资助他们的工作.

思考电脑也是如此。 任何接管世界的全面计划都需要数千人的合作。 没有理由相信计算机比科学家效率更高. 恰恰相反,鉴于友情、组合和魅力是多少,一个没有朋友的不健全的计算机程序将处于极大的劣势。

雷·克兹韦尔(Ray Kurzweil)认为, 计算机总有一天会变得如此聪明, 最有力量的想法不是只有发明者能理解的想法. 最强大的思想是那些被许多人广泛接受和理解,使其对世界的影响倍增的思想. 它既有利于人类思想,也有利于机器思想. 为了改变世界,超级智能计算机需要给公众带来变化.

5 (韩语). 智取越多,价值就越低

人们会期望计算机利用他们的优越智慧变得惊人地富有,然后利用其巨大的财富来贿赂人们. 但是它忽略了一个重要的经济原则:随着资源变得越来越普遍,其价值会下降.

60年前,一台可能低于现代智能手机的计算机价值数百万. 现代计算机可能比前几代计算机强大得多,但计算功率的价值下降快于其能力提高.

因此,第一台超级智能计算机可能会赚到很多钱,但是它的优势会一去不复返. 随着计算机芯片在计算能力上的价值和收益持续下降,人们会建造出更多的超级智能计算机. 他们的独特能力将变得平庸.

在一个知识丰富的世界中,最宝贵的资源将是有限的资源——土地、能源、矿物。 因为这些资源被人类控制, 我们至少会拥有同样多的 智能计算机的影响力。

资料来源:hi-news.ru。

资料来源:/用户/1617。