481

史蒂芬*霍金在人工智能

着名的英国物理学家斯蒂芬霍金,在一篇文章中鼓舞的梦幻影"优势"(超越)的约翰尼*德普主导作用,他说,该低估造成的威胁的人工智能可以最大的错误,在人类历史。

文章、合着的计算机科学的教授,斯图尔特*罗素的加利福尼亚大学伯克利分校和物理学教授最大Tegmark和弗兰克Wilchelm从马萨诸塞技术学院,霍金分到一些领域取得的成就的人工智能,并指出,自动驾驶的汽车,语音助理Siri和超级计算机被击败的人在电视游戏节目-危险的测验。

所有这些成就掩盖什么在等待着我们在未来几十年。 成功创建的人工智能变为最大的事件在人类历史。 不幸的是,这可能是最后的,除非我们学会如何避免风险,引述英国报纸独立的话霍金。

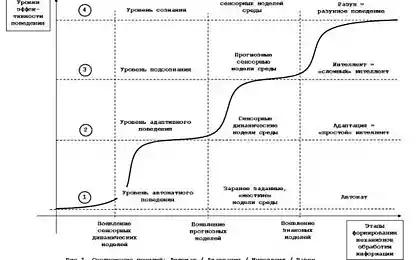

教授编写,在未来可能发生,没有人,没有什么可以阻止机器有超人的智慧,从自我完善。 这将启动该进程的所谓的技术奇点,这是非常快速的技术发展。 在影片与德普在这个意义上,该词"超越"的。

只是想象这种技术将超过该人员将管理金融市场、研究、人员和武器越过我们的理解。 如果短期影响的人工智能取决于由谁控制它,长期效果是否可以管理的。

这是很难说有什么影响,它可以对人民、人工智能。 霍金认为,这是问题的点严肃的研究之外的非盈利组织如剑桥大学研究中心的存在风险,未来的人类学研究院和研究机构机情报和未来的生活。 据他说,我们每个人必须问问自己,我们现在可以做,以避免最坏的情况的未来。

资料来源:brainswork.ru