472

0.1

2016-09-21

Создана программа для распознавания эмоций

Эмоциональное состояние можно определить по тому, как человек набирает текст на клавиатуре компьютера.

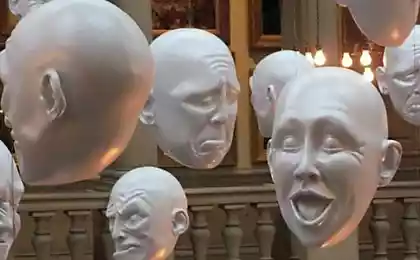

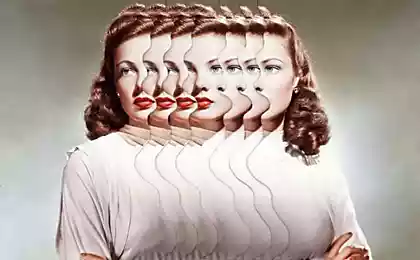

Наши эмоции проще всего определить по выражению лица и по голосу. Однако лиц и голосов на свете столько же, сколько людей, и как мы можем быть уверены, что какая-то эмоциональная гримаса у разных людей выражает одно и то же – например, страх, или радость, или грусть?

На самом деле, для нас с вами тут никакой проблемы нет, наша психика легко справляется с многообразием особенностей чужой внешности и легко вычленяет в мимике общие эмоциональные компоненты. То же самое происходит и с голосом. Однако, если мы зададимся целью обучить распознаванию эмоций робота, то нам понадобятся чёткие критерии, по которым машина смогла бы отличать страх от радости, а радость от грусти в любой их интенсивности, с любыми оттенками и на любых лицах.

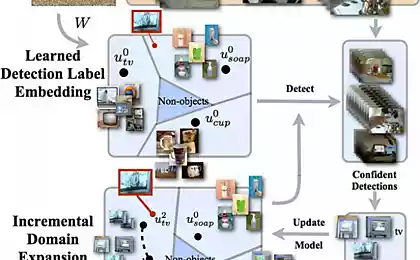

Исследователи из Исламского технологического университета в Бангладеш выбрали для решения этой задачи оригинальный способ: они сосредоточились не на мимике, а на пальцах. Программа для распознавания эмоций должна была ориентироваться на то, как человек печатает на клавиатуре. В первой части эксперимента 25 добровольцев в возрасте от 15 до 40 лет перепечатывали кусок текста из «Алисы в Стране Чудес» Льюиса Кэрролла, одновременно отмечая своё эмоциональное состояние: радость, страх, гнев, грусть, стыд и т. д. Если определённых эмоций не было, можно было выбрать усталость или нейтральные эмоции. (Понятно, что эмоции могли быть никак с текстом не связаны, человек мог заниматься набором текста, находясь под влиянием каких-то своих мыслей и чувств.)

Во второй части эксперимента добровольцы печатали уже что-то своё, но каждые полчаса им напоминали про определённую эмоцию: грусть, стыд, страх, радость и далее по списку – они должны были войти в это эмоциональное состояние и пребывать в нём, пока набирали текст. Одновременно специальная программа собирала информацию о том, как пользователи нажимают на кнопки клавиатуры.

В статье в Behavior & Information Technology авторы работы пишут, что им удалось выделить 19 ключевых параметров, по которым можно было судить об эмоциональном состоянии печатающего. Среди них были, например, скорость печати в интервале в пять секунд, и время, в течение которого клавиша оставалось нажатой. Значения параметров, измеренные на произвольном тексте, сопоставляли со стандартными значениями для конкретных эмоций и слов, которые получили с помощью текста Кэрролла. Таким способом, как уверяют исследователи, можно с большой достоверностью определить семь разных эмоций. Достовернее всего это удавалось с радостью (правильный ответ был в 87% случаев) и с гневом (правильный ответ – в 81% случаев).

По сравнению с детекторами эмоций, работающими с мимикой и голосовыми интонациями, у «печатного» метода есть один заметный минус: если эмоция на лице и в голосе проявляется непосредственно, то тут человек должен что-то делать – набирать текст. Если он не будет печатать, то и эмоции не получится определить. Так что, очевидно, такой способ должен работать в связке с мимическими и голосовыми детекторами. Впрочем, сам по себе он тоже может пригодиться: представим, например, психологическую консультацию онлайн – в такой ситуации психолог мог бы получить сведения об эмоциональном состоянии пациента только по его манере печатать, а заодно и сравнить, насколько эмоции человека соответствуют содержанию набираемых им сообщений.

Наши эмоции проще всего определить по выражению лица и по голосу. Однако лиц и голосов на свете столько же, сколько людей, и как мы можем быть уверены, что какая-то эмоциональная гримаса у разных людей выражает одно и то же – например, страх, или радость, или грусть?

На самом деле, для нас с вами тут никакой проблемы нет, наша психика легко справляется с многообразием особенностей чужой внешности и легко вычленяет в мимике общие эмоциональные компоненты. То же самое происходит и с голосом. Однако, если мы зададимся целью обучить распознаванию эмоций робота, то нам понадобятся чёткие критерии, по которым машина смогла бы отличать страх от радости, а радость от грусти в любой их интенсивности, с любыми оттенками и на любых лицах.

Исследователи из Исламского технологического университета в Бангладеш выбрали для решения этой задачи оригинальный способ: они сосредоточились не на мимике, а на пальцах. Программа для распознавания эмоций должна была ориентироваться на то, как человек печатает на клавиатуре. В первой части эксперимента 25 добровольцев в возрасте от 15 до 40 лет перепечатывали кусок текста из «Алисы в Стране Чудес» Льюиса Кэрролла, одновременно отмечая своё эмоциональное состояние: радость, страх, гнев, грусть, стыд и т. д. Если определённых эмоций не было, можно было выбрать усталость или нейтральные эмоции. (Понятно, что эмоции могли быть никак с текстом не связаны, человек мог заниматься набором текста, находясь под влиянием каких-то своих мыслей и чувств.)

Во второй части эксперимента добровольцы печатали уже что-то своё, но каждые полчаса им напоминали про определённую эмоцию: грусть, стыд, страх, радость и далее по списку – они должны были войти в это эмоциональное состояние и пребывать в нём, пока набирали текст. Одновременно специальная программа собирала информацию о том, как пользователи нажимают на кнопки клавиатуры.

В статье в Behavior & Information Technology авторы работы пишут, что им удалось выделить 19 ключевых параметров, по которым можно было судить об эмоциональном состоянии печатающего. Среди них были, например, скорость печати в интервале в пять секунд, и время, в течение которого клавиша оставалось нажатой. Значения параметров, измеренные на произвольном тексте, сопоставляли со стандартными значениями для конкретных эмоций и слов, которые получили с помощью текста Кэрролла. Таким способом, как уверяют исследователи, можно с большой достоверностью определить семь разных эмоций. Достовернее всего это удавалось с радостью (правильный ответ был в 87% случаев) и с гневом (правильный ответ – в 81% случаев).

По сравнению с детекторами эмоций, работающими с мимикой и голосовыми интонациями, у «печатного» метода есть один заметный минус: если эмоция на лице и в голосе проявляется непосредственно, то тут человек должен что-то делать – набирать текст. Если он не будет печатать, то и эмоции не получится определить. Так что, очевидно, такой способ должен работать в связке с мимическими и голосовыми детекторами. Впрочем, сам по себе он тоже может пригодиться: представим, например, психологическую консультацию онлайн – в такой ситуации психолог мог бы получить сведения об эмоциональном состоянии пациента только по его манере печатать, а заодно и сравнить, насколько эмоции человека соответствуют содержанию набираемых им сообщений.

Портал БАШНЯ. Копирование, Перепечатка возможна при указании активной ссылки на данную страницу.